Anthropic利用Claude Code实现软件安全审查自动化

生成式人工智能初创公司Anthropic PBC今天推出了Claude Code的自动化软件安全审查功能,能够识别和修复代码中的潜在漏洞和弱点。

随着代码复杂度的增加,软件工程师开始采用人工智能作为开发过程的一部分,代码中的安全问题数量也随之增加。根据Verizon的2025年数据泄露调查报告,与去年的报告相比,攻击者利用漏洞获取初始访问的情况增加了34%。

开发人员越来越多地使用人工智能来加速他们的工作流程并创建更复杂的系统,这导致了代码生成的激增。的代码生成。安全审查是这一过程的关键;它们涉及对代码进行彻底检查,以确保其通过单元测试正确运行,并且不包含攻击者可能利用的漏洞或已知漏洞。

Claude Code是Anthropic提供的一个命令行工具,驻留在由公司AI模型驱动的终端中,这使得开发人员可以使用自然语言自动化编码任务并与代码库互动。通过GitHub Actions,开发人员现在可以轻松地要求Claude识别安全问题并进行修复。

在编写代码后,开发人员可以输入“/security-review”,Claude Code将在提交代码之前开始临时安全分析。公司的AI模型将搜索代码库中的潜在漏洞,并提供详细的发现问题的解释。

“此命令使用专门的安全提示,检查常见的漏洞模式,”公司表示。

Claude可以发现的潜在漏洞类型包括SQL注入风险、跨站脚本攻击、身份验证和授权缺陷、不安全的数据处理和依赖性漏洞。开发人员还可以要求Claude Code为每个问题实施解决方案在它们被识别后。Anthropic表示,这使得安全审查保持在内部开发循环中,能够在问题更容易修复时及早发现。

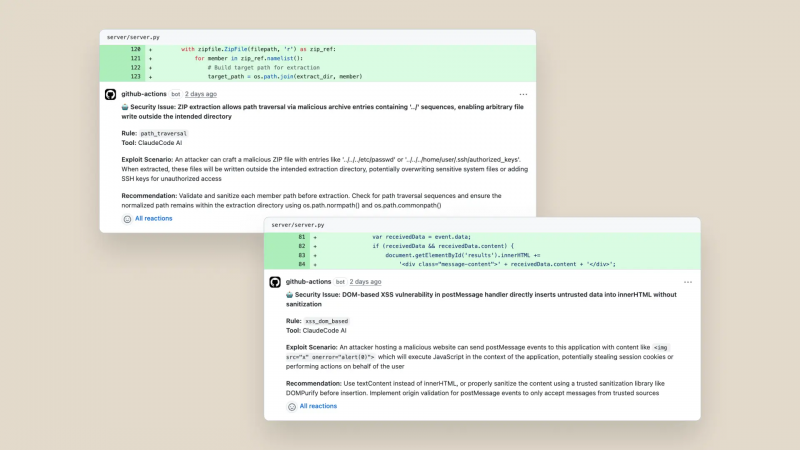

更进一步,Claude Code可以在代码从开发转移到测试时自动启动。AI模型扫描代码,努力过滤掉误报,并 将其评论发布到关于其发现的任何安全问题的票据中,包括建议和修复。

这样,开发团队可以审查潜在问题和建议并进行跟进。。 根据Anthropic的说法,这确保了没有代码在没有至少进行自动化安全审查的情况下进入生产发生。它还可以轻松集成到自动化的DevOps持续集成和持续部署管道中。

该系统可以根据团队的安全政策和最佳实践进行定制。这种定制使公司能够在工作流程集成期间修改其敏感性、行为和与开发人员的协作。

其他主要科技公司也发布了自己的代码代理和助手,包括Google LLC的Code Assist,Amazon.com Inc.的Q Developer和Microsoft Corp.的AI驱动代码审查助手,这些工具可以大规模扫描代码库中的漏洞并建议修复。许多这些系统同样连接到GitHub,允许开发人员标记潜在的错误,改进他们的代码,并释放人类审查员以专注于架构问题。

Anthropic补充说,公司本身也在使用新的安全审查功能来保护团队发布到生产的代码,包括Claude Code本身。例如,上周Anthropic表示,其团队为一个内部工具构建了一个新功能,该功能依赖于启动一个本地HTTP服务器以接受本地连接。GitHub操作识别出一个通过DNS重绑定可利用的远程代码执行漏洞,并在代码合并之前修复了它。