将大脑作为模型可以产生更强大的人工智能

大多数人工智能系统都是基于神经网络的,这些神经网络算法受到大脑中生物神经元的启发。这些网络可以由多个层组成,输入从一侧进入,输出从另一侧出去。输出可以用于作出自动决策,例如在无人驾驶汽车中。

误导神经网络的攻击可能会利用输入层的漏洞,但在构建防御时通常只考虑初始输入层。研究人员第一次通过使用随机噪声增强神经网络的内层来提高其强度。

人工智能(AI)已经成为一种相对常见的东西;你有一个带有AI助手的智能手机,或者你使用由AI驱动的搜索引擎。虽然这是一个广义的术语,可以包括许多不同的处理信息和作出决策的方式,但AI系统通常是使用类似于大脑的人工神经网络(ANN)构建的。

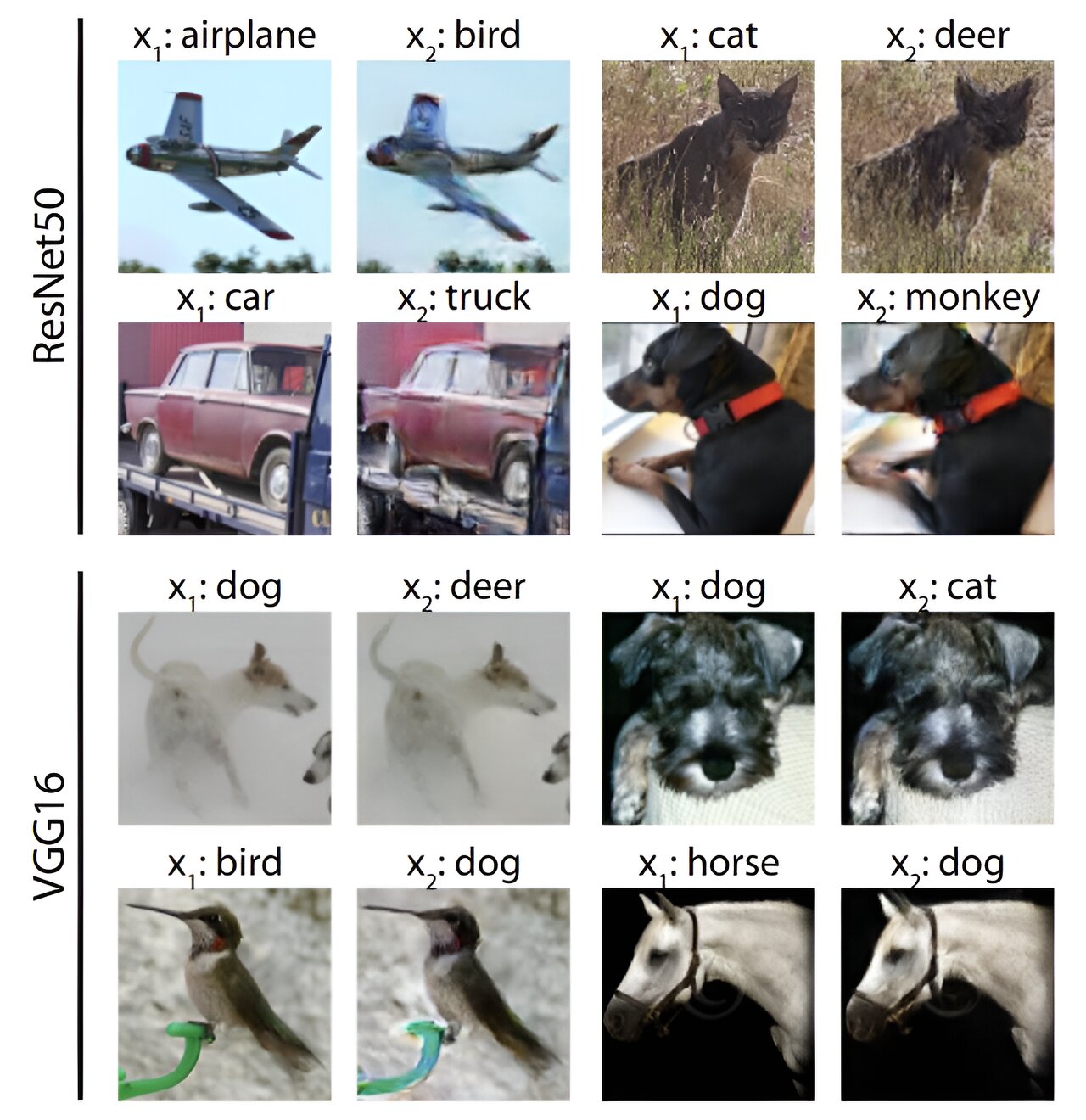

就像大脑一样,ANN有时也会感到困惑,无论是偶然还是第三方的故意行为。想象一些视觉输入可能会看起来完全正常,或者至少对我们来说是可以理解的,但是却可能被ANN解释为完全不同的东西。

一个简单的例子可能是图像分类系统将猫误认为狗,但更严重的例子可能是无人驾驶车辆将停车信号误认为通行信号。不仅仅是无人驾驶车辆,还有医学诊断系统和许多其他敏感的应用,它们接受输入并提供信息,甚至作出可能影响人们的决策。

由于输入不一定是可视化的,所以在并不总是能够很容易地分析出系统犯错的原因。试图破坏基于ANN的系统的攻击者可以利用这一点,巧妙地改变已经设定的输入模式,让输入的内容被错误地解释,并导致系统将错误地行动,甚至可能带来问题。

针对这些攻击的防御技术有一些局限性。东京大学医学研究生院生理学系的最近毕业生Jumpei Ukita和Kenichi Ohki教授设计并测试了一种改进ANN防御的新方法。

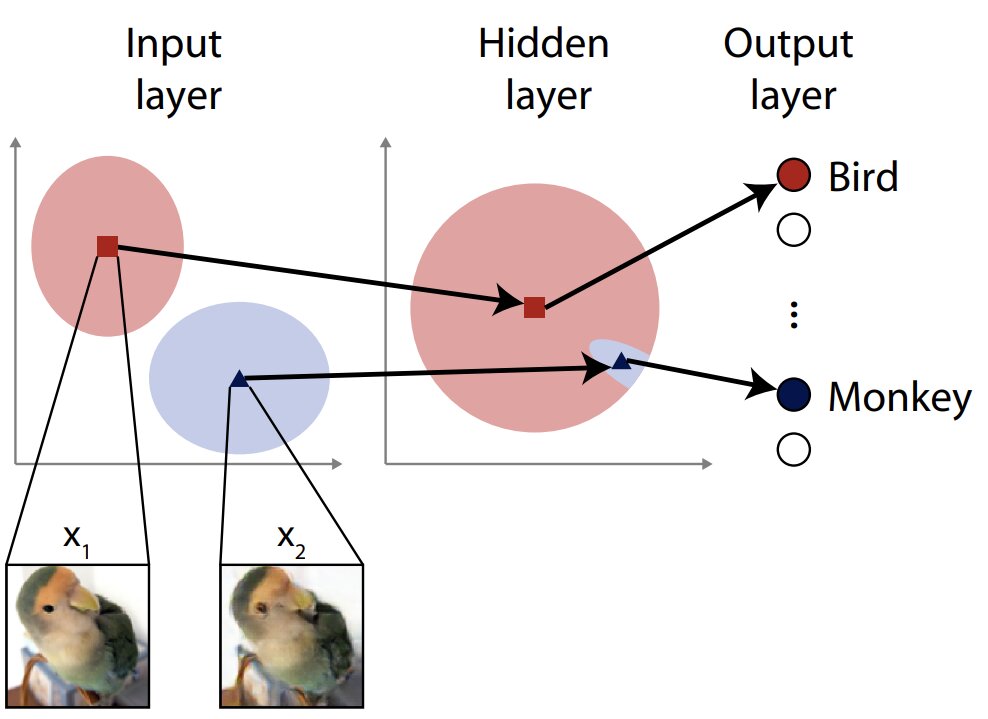

Ohki说:“神经网络通常由层层虚拟神经元组成。前几层通常负责通过识别与某种输入对应的元素来分析输入。”

“攻击者可能会提供带有欺骗网络的伪影的图像,使其被错误分类。针对这种攻击的典型防御措施可能是故意在这第一层引入一些噪声。这听起来似乎与解决问题相悖,但通过这样做,它可以对视觉场景或其他输入集有更大的适应性。但这种方法并不总是那么有效,我们认为可以通过将目光从输入层延伸到网络内部来改善这一问题”

Ukita和Ohki不仅是计算机科学家,他们还研究了人脑,这激发了他们在ANN中使用他们所了解的大脑中的现象。他们不仅为输入层添加噪声,还为更深的层次添加噪声。通常会避免这样做,因为害怕这会影响网络在正常条件下的有效性。但对于他们的测试的ANN而言并非如此,噪声提高了其适应能力,从而减少了其受模拟对抗性攻击的影响。

Ukita说:“我们的第一步是设计一种攻击深度超过输入层的假设的攻击方法。这种攻击需要在输入层使用标准噪声防御来抵御网络的恢复能力。我们称之为特征空间对抗性示例。”

“这些攻击通过提供一个与ANN可以正确分类的输入完全不相近的输入来工作。但关键是将巧妙的误导性伪影呈现给更深层次的神经元。一旦我们证明了这种攻击的危害性,我们就会在网络的更深层次注入随机噪声,以提高它们的适应能力和防御能力。我们很高兴这是行之有效的。”

尽管这个新思路证明了其稳健性,但该团队希望进一步发展它,使其对预期的攻击,以及他们尚未测试的其他类型的攻击更加有效。目前,这种防御只针对这种特定的攻击方式起作用。

Ukita说:“未来的攻击者可能会考虑到我们在这项研究中考虑过的问题。实际上,攻击和防御是同一枚硬币的两面;这是一场双方都不会退缩的军备竞赛,所以我们需要不断改进创新,以保护我们每天使用的系统。”