模型:

facebook/wav2vec2-large-xlsr-53

英文

英文Wav2Vec2-XLSR-53

基于16kHz采样的语音音频进行预训练的基础模型。在使用该模型时,请确保您的语音输入也是以16Khz进行采样的。请注意,该模型应在下游任务(如自动语音识别)上进行微调。有关更多信息,请参阅 this blog 。

作者:Alexis Conneau,Alexei Baevski,Ronan Collobert,Abdelrahman Mohamed,Michael Auli

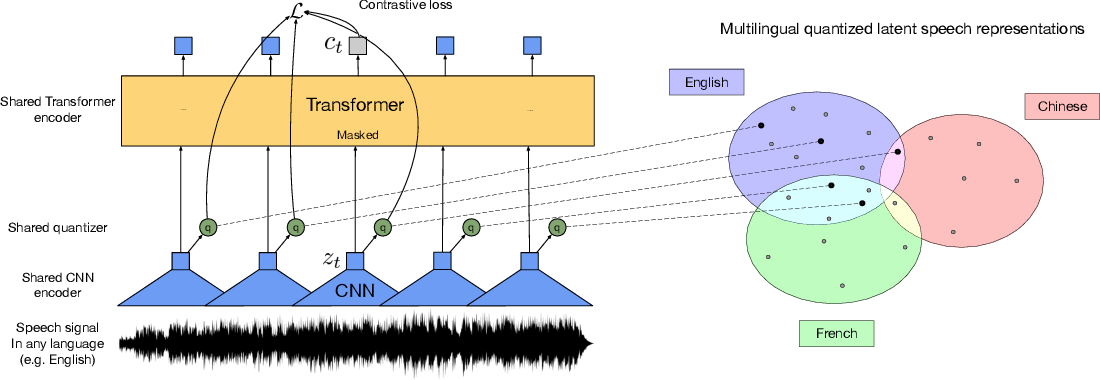

摘要 本论文介绍了XLSR,通过在多种语言的原始波形上预训练单个模型,从而学习跨语言的语音表示。我们基于wav2vec 2.0进行构建,它通过解决对掩码潜在语音表示的对比任务进行训练,并共同学习跨语言共享的离散潜在语音量化。实验结果表明,跨语言预训练明显优于单语言预训练。在CommonVoice基准测试中,相对于已知的最佳结果,XLSR的相对音素错误率降低了72%。在BABEL中,与可比系统相比,我们的方法相对提高了16%的词错误率。我们的方法实现了一个单一的多语言语音识别模型,与强大的单个模型相竞争。分析显示,潜在的离散语音表示在不同语言之间是共享的,并且对于相关语言的共享程度增加。我们希望通过发布在53种语言中进行预训练的大型模型XLSR-53来推动低资源语音理解的研究。

可以在 https://github.com/pytorch/fairseq/tree/master/examples/wav2vec#wav2vec-20 找到原始模型。

使用方法

有关如何对模型进行微调的更多信息,请参阅 this notebook 。