英文

英文Mask2Former

Mask2Former 模型是在 Mapillary Vistas 全景分割(大型版本,Swin 骨干)上进行训练的。该模型在 论文 中首次发布。

声明:发布 Mask2Former 模型的团队并未针对该模型撰写模型卡片,因此此模型卡片由 Hugging Face 团队编写。

模型描述

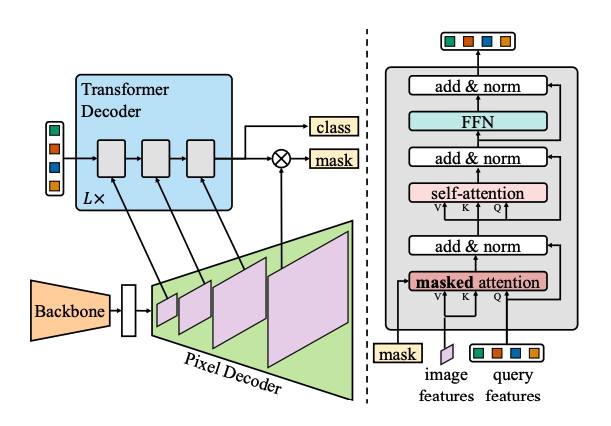

Mask2Former 可以处理实例分割、语义分割和全景分割,采用相同的范式:预测一组掩膜和相应的标签。因此,这三个任务都被视为实例分割。与先前的 SOTA 模型相比,在性能和效率方面,Mask2Former 通过以下三种方式取得了更好的性能:(i) 用更先进的多尺度可变形注意力 Transformer 替换像素解码器,(ii) 采用带有掩码注意力的 Transformer 解码器以提高性能而不引入额外计算,(iii) 通过计算部分采样点上的损失而不是全局掩膜来提高训练效率。

预期用途和限制

您可以使用这个特定的检查点进行全景分割。查看 文档,以查找在您感兴趣的任务上的其他微调版本。

如何使用

以下是如何使用此模型的方法:

import requests

import torch

from PIL import Image

from transformers import AutoImageProcessor, Mask2FormerForUniversalSegmentation

# load Mask2Former fine-tuned on Mapillary Vistas panoptic segmentation

processor = AutoImageProcessor.from_pretrained("facebook/mask2former-swin-large-mapillary-vistas-panoptic")

model = Mask2FormerForUniversalSegmentation.from_pretrained("facebook/mask2former-swin-large-mapillary-vistas-panoptic")

url = "http://images.cocodataset.org/val2017/000000039769.jpg"

image = Image.open(requests.get(url, stream=True).raw)

inputs = processor(images=image, return_tensors="pt")

with torch.no_grad():

outputs = model(**inputs)

# model predicts class_queries_logits of shape `(batch_size, num_queries)`

# and masks_queries_logits of shape `(batch_size, num_queries, height, width)`

class_queries_logits = outputs.class_queries_logits

masks_queries_logits = outputs.masks_queries_logits

# you can pass them to processor for postprocessing

result = processor.post_process_panoptic_segmentation(outputs, target_sizes=[image.size[::-1]])[0]

# we refer to the demo notebooks for visualization (see "Resources" section in the Mask2Former docs)

predicted_panoptic_map = result["segmentation"]

对于更多代码示例,我们建议查看 文档。