百度文心一言 5.1 版本预训练成本降低 94%,性能可对标顶级大模型

百度正式发布文心一言 5.1 大模型。该模型在文心一言 5.0的预训练基础上迭代升级,整体参数量约为前代版本的三分之一,单次调用的有效活跃参数量仅为原来的一半。

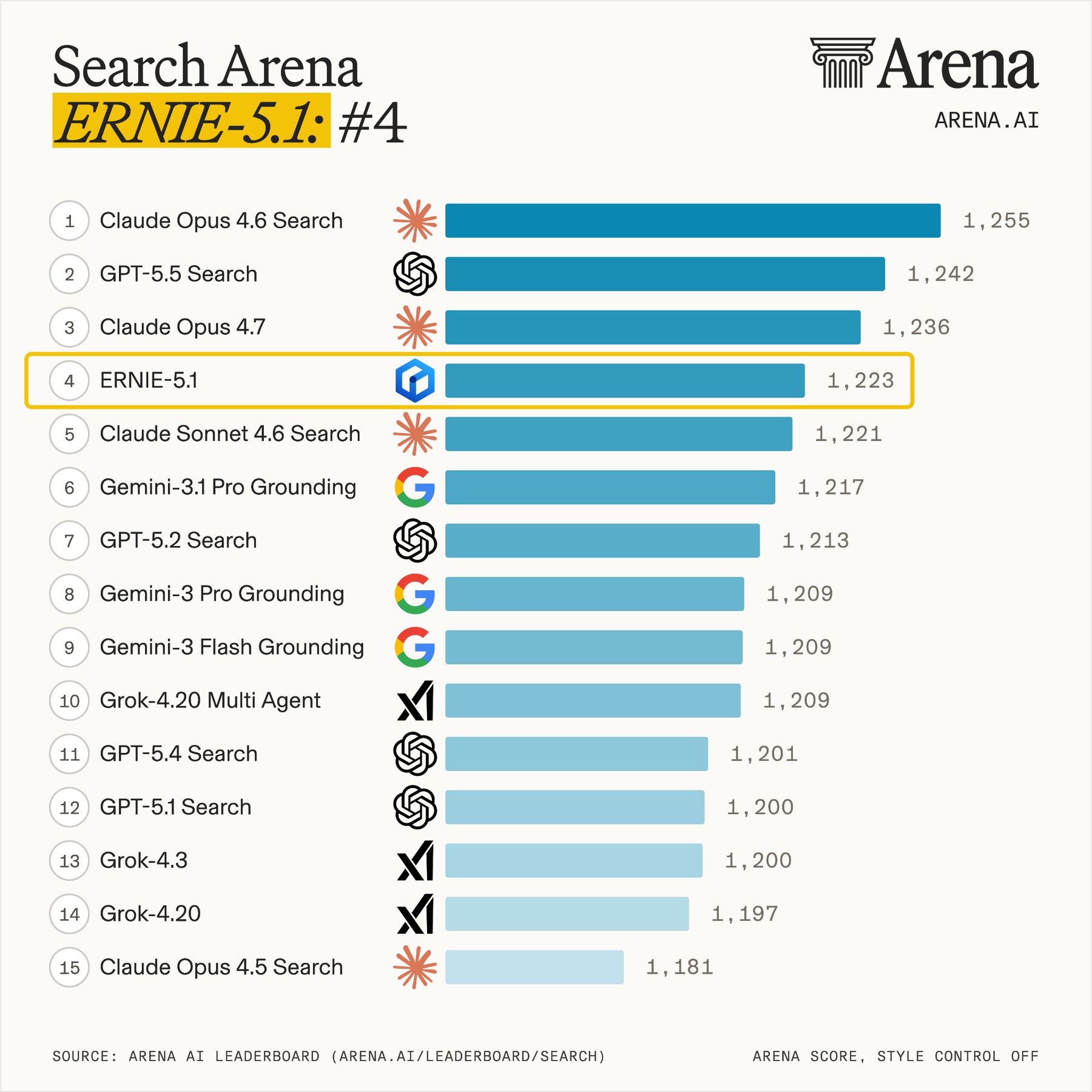

百度表示,文心一言 5.1 的预训练成本仅为同级别主流大模型所需成本的6%。截至 5 月 9 日,文心一言 5.1 在 Arena 搜索排行榜上斩获 1223 分,位列全球第四、国产大模型第一。

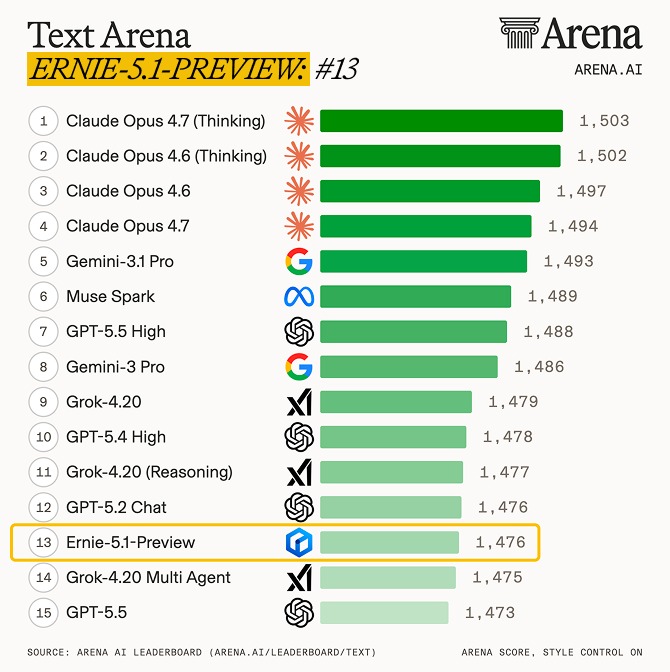

百度称,在更多基准测试中,文心一言 5.1 在自主智能体任务(tau3-bench、SpreadsheetBench-Verified)上超越了 DeepSeek-V4-Pro;在知识与推理类基准测试(GPQA、MMLU-Pro)中表现接近谷歌 Gemini 3.1 Pro。在高难度数学基准测试(AIME26)里,开启工具调用能力的文心一言 5.1 成绩仅略逊于 Gemini 3.1 Pro。百度表示,内部评测还显示,该模型在创意写作能力上已比肩海外主流商用大模型。

文心一言 5.1 是基于前代版本打造的轻量化模型

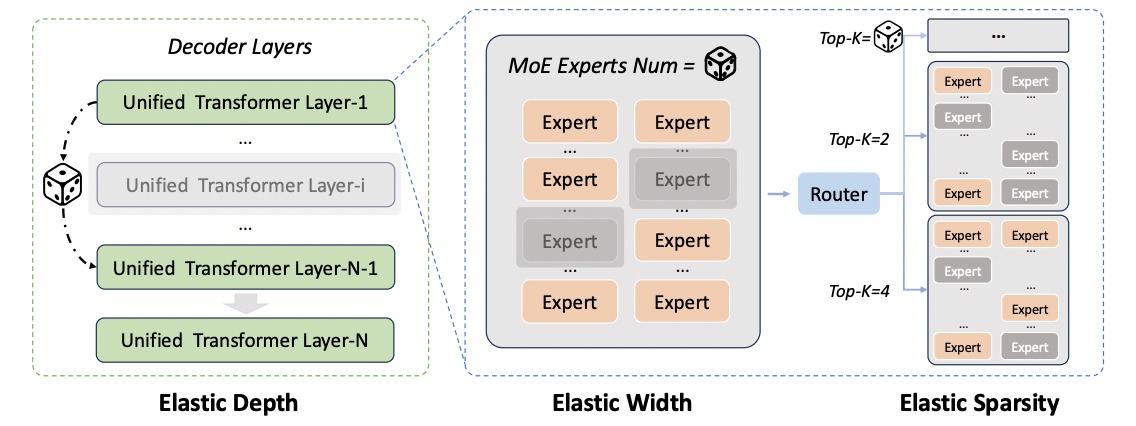

百度依托自研的一次就绪弹性训练框架,从文心一言 5.0 中衍生出轻量化子模型文心一言 5.1。该方式无需为不同规格的模型单独进行成本高昂的预训练,而是仅通过一次训练,就能对一整套不同参数量规格的模型完成整体优化。

这些模型共享模型权重,仅在网络深度、宽度,以及单次请求所激活的专属专家模块数量上存在差异。百度从该模型家族中筛选出最优配置,打造出文心一言 5.1。这也是其预训练成本极低的原因 —— 繁重的算力训练工作早已在文心一言 5.0 阶段完成。

除此之外,百度对强化学习底层架构进行了全新重构。传统架构中,模型更新、回复生成、性能评估三大核心环节高度耦合;如今百度将其拆分为可独立扩容的子系统,由中央控制器统一调度协调。官方表示,各环节可匹配专属硬件资源,任一环节出现性能瓶颈,都不会拖累其他环节运行。

大模型强化学习长期面临一大难题:因计算环境配置不同,会导致训练过程与样本生成出现偏差漂移,进而造成整体训练流程不稳定。百度通过自研标准化低精度计算库,搭配针对混合专家模型的偏差校正机制,将偏差漂移幅度降低一半,同时几乎不损失运行速度。

四阶段流程化解 “跷跷板效应”

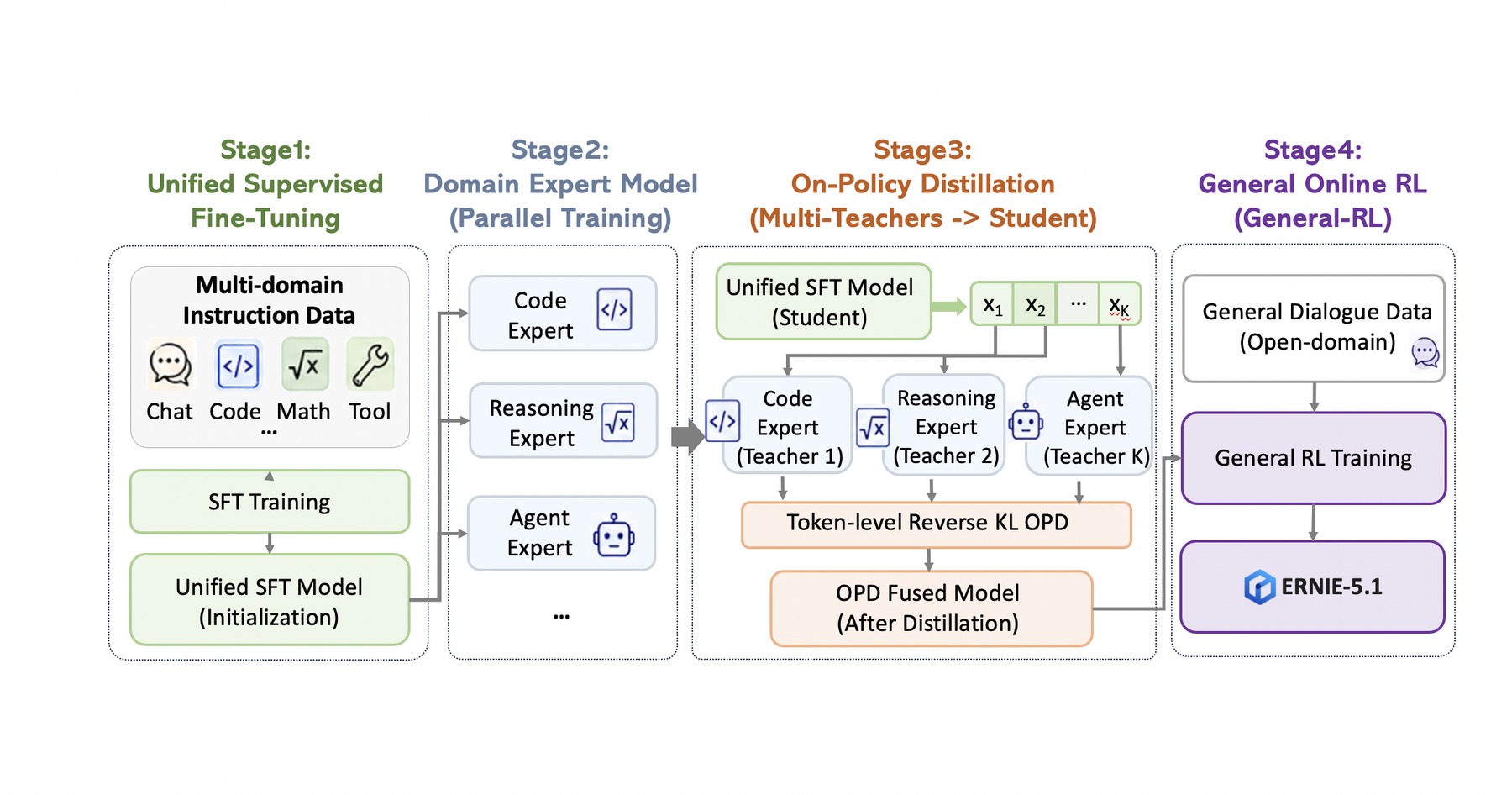

百度采用四阶段微调流程,攻克了行业普遍难题:同时训练多项能力时,往往会出现某项能力提升、另一项能力随之下降的情况。百度将这种现象定义为“跷跷板效应”—— 代码能力、逻辑推理与创意创作三者之间容易相互掣肘、此消彼长。

整个流程首先在海量通用数据集上开展标准有监督训练。第二阶段并行训练多个专用专家子模型,分别对应代码、推理、智能体任务三大方向,且每个子模型都配有独立的评估指标体系。

第三阶段,单个学生模型同时向所有这些专家模型学习:自行生成回答,并与各专家模型的输出结果进行比对学习。最后一个阶段引入通用强化学习,适配开放式对话与创意创作任务。百度表示这一步必不可少,因为师生蒸馏模式产出的答案往往过于规整、缺乏多样性。

可在创意平台使用,暂不开放模型权重

文心一言 5.1 已在文心官网(ernie.baidu.com)及百度飞桨 AI Studio 体验广场上线,同时将陆续登陆十余款创意平台,包括角色扮演平台异世界零、智能体创作工具木兰 AI、AI 画布应用谛听环流、短剧生成平台故事大师等。

和文心一言 5.0 一样,百度未开源模型权重,因此外界无法独立核验其基准跑分与效能相关宣称。

百度早在 2026 年 1 月发布文心一言 5.0 时,就为此次轻量化版本的推出做好了铺垫。文心一言 5.0 采用混合专家架构,以统一模型结构处理文本、图像、音频、视频多模态内容,整体总参数量约 2.4 万亿,单次调用仅激活不到 3% 的参数。