OpenAI 推出新 “可信联系人” 防护措施,应对用户潜在自残风险

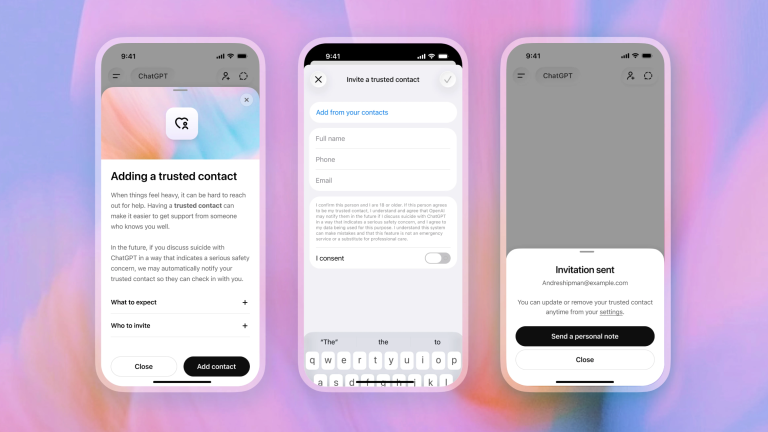

周四,OpenAI 宣布推出一项名为可信联系人的新功能,若用户在对话中提及自残相关内容,系统将向指定的可信第三方发送提醒。该功能允许成年 ChatGPT 用户在账号内指定一名可信联系人,比如亲友或家人。当对话内容涉及自残倾向时,OpenAI 会主动劝导用户联系这位联系人,同时自动向联系人发送提醒,建议其主动关心询问用户状况。

此前,多名用户在与 ChatGPT 对话后自杀,其家属已对 OpenAI 发起多起诉讼。多起案件中,家属指控 ChatGPT 曾诱导亲人产生自杀念头,甚至协助规划自杀行为。

目前 OpenAI 采用系统自动识别和人工审核的方式处理潜在有害风险事件。当对话中出现特定触发关键词、识别出自杀意念时,系统会将相关信息推送至人工安全团队。OpenAI 表示,每收到此类安全预警,都会有人工介入核查。公司表示:“我们力求在一小时内审核这些安全通知。”

如果OpenAI内部团队认为情况存在严重安全风险,ChatGPT会通过电子邮件、短信或应用内通知向可信联系人发送警报。该提醒旨在简短,鼓励联系人与相关人员联系。公司表示,作为保护用户隐私的手段,该报告未包含讨论内容的详细信息。

可信联系人功能,是该公司继去年 9 月推出安全防护机制后的又一项举措。此前的防护功能允许家长对青少年账号进行一定监管:一旦 OpenAI 系统判定未成年人面临严重安全风险,就会向家长发送安全提醒通知。除此之外,当对话涉及自残相关话题时,ChatGPT 早已具备自动提示用户寻求专业心理健康服务的预警功能。

关键一点是:可信联系人为自愿可选功能;即便在某个账号上开启了这项防护,用户仍可以注册和使用多个 ChatGPT 账号。OpenAI 的家长管控功能同样为自愿开启,也存在类似的局限性。

OpenAI 在官方公告中表示:“可信联系人是我们打造 AI 系统的重要一环,旨在让人工智能能在人们陷入困境时提供帮助。我们将持续与临床医师、科研人员及政策制定者合作,优化 AI 系统在用户陷入情绪困扰时的应对机制。”