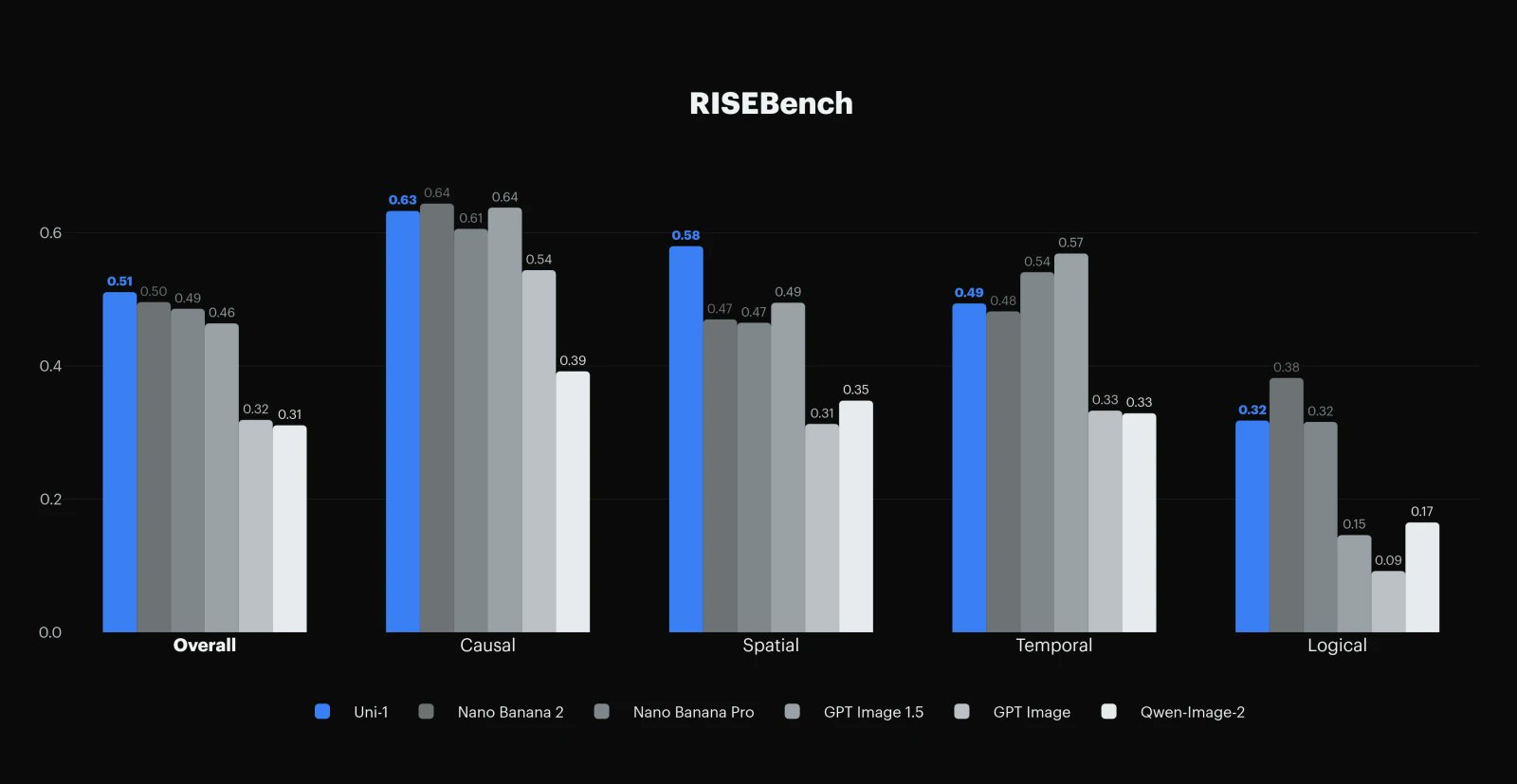

Luma AI 的新Uni-1 图像模型在基于逻辑的基准测试中超越了Nano Banana 2和GPT Image 1.5

2026年03月09日 由 alex 发表

3995

0

Luma AI 推出了 Uni-1,这是其首个将图像理解与图像生成结合在单一架构中的模型。

与谷歌的Nano Banana Pro和GPT Image 1.5类似,Uni-1基于自回归变换器构建,这是一种按顺序生成内容令牌的AI模型,而非像传统扩散模型那样从噪声中提取图像。文本和图片共享相同的处理流程。

Luma表示,模型可以在生成前和生成过程中推理提示,拆解复杂的指令并规划场景。这种方法通常能带来更准确的提示跟随,Uni-1也不例外。例如,它可以拍摄多张照片并将它们合成出全新的构图。

除了基础生成,Luma表示,Uni-1还能在多个对话回合中细化主题,同时保持上下文完整,将图像转换为76种以上的艺术风格,接受草图和视觉指令作为输入,并将身份、姿势和构图从参考照片转移到新图像中。在一个演示中,模型从单一参考图像生成了整段序列,逐步将钢琴家从童年发展到老年。

据Luma介绍,Uni-1在基于逻辑的图像处理RISEBench测试中得分最高,略胜Nano Banana 2和GPT Image 1.5。图像生成能力还提升了模型的视觉理解能力。例如,在物体识别方面,它几乎可以媲美谷歌的Gemini 3 Pro。该模型支持多种语言。

Uni-1 很快将通过新推出的创意助手 Luma Agents 和 Luma API 提供。目前尚未公布具体价格。

文章来源:https://the-decoder.com/luma-ais-new-uni-1-image-model-tops-nano-banana-2-and-gpt-image-1-5-on-logic-based-benchmarks/

欢迎关注ATYUN官方公众号

商务合作及内容投稿请联系邮箱:bd@atyun.com

热门企业

热门职位

写评论取消

回复取消