OpenAI推出Codex Security,助力开发者修复软件漏洞

OpenAI集团PBC今日宣布推出Codex Security,这是一款集成在其Codex编程助手中的新工具,旨在帮助开发者发现和修复代码中的漏洞。

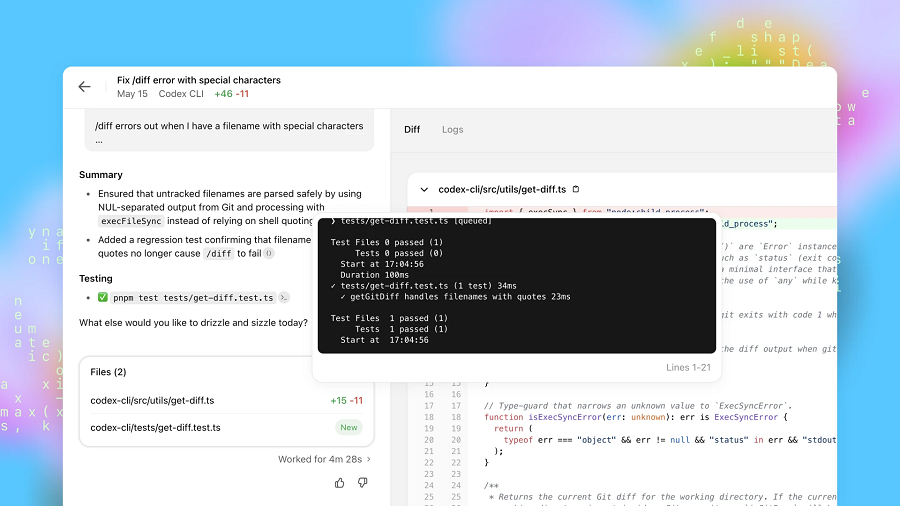

此次发布是在Anthropic PBC推出一款竞争产品两周后进行的。Claude Code Security可以分析应用程序的代码库,识别漏洞并提出修复建议。Codex Security的工作方式与之类似。开发者可以通过让OpenAI的新工具访问他们希望扫描的代码库来激活它。根据ChatGPT的开发者,Codex Security会在一个隔离的容器中创建代码库的临时副本。然后,它会分析代码文件,这个过程可能需要几天时间。

Codex Security的分析会生成一个OpenAI称之为威胁模型的文档。这是一个详细的自然语言描述,说明程序的工作原理及可能存在的漏洞。应用程序的威胁模型包括界面元素的信息,这些元素允许终端用户上传数据。这类模块特别容易受到网络攻击。

如果有必要,开发者可以自定义威胁模型。例如,用户可以添加更多关于某个特别敏感的应用程序组件的细节,Codex Security应该优先考虑。该工具使用威胁模型来指导其漏洞扫描。

模型在沙箱中测试它发现的缺陷,以确定它们是否可以被黑客利用。在过滤掉误报后,该工具根据漏洞的严重性进行排名。为了增加保障,它会保存未通过沙箱测试的缺陷日志。开发者可以使用这些日志来搜索可能被误标为误报的漏洞。

Codex Security为它发现的每个漏洞生成一个修复建议。建议包括修复问题所需的代码和自然语言解释。开发者在审查建议的代码后,可以通过点击按钮将其推送到生产环境。

这个新模型最初是一个名为Aardvark的内部工具,OpenAI用它来分析自己的代码文件。去年,公司启动了一个测试计划,使该工具对有限数量的客户开放。OpenAI表示,该测试计划帮助其将Code Security的误报减少了50%以上。

该工具帮助早期用户检测到超过11,000个关键和高严重性漏洞。此外,OpenAI还用它扫描了一些支持其工作负载的流行开源工具。公司发现了14个严重到足以被列入CVE数据库的漏洞。

Codex Security在ChatGPT的企业、商业和教育层级中作为研究预览版提供。此外,OpenAI还启动了一个计划,使开源项目维护者可以免费访问该工具。