Inception 推出 Mercury 2,首个基于扩散的语言推理模型

人工智能初创公司Inception Labs推出了首个基于扩散的推理AI模型。它又快又便宜。

与传统语言模型不同,Mercury 2 是同时细化多个文本块,而不是逐字逐字地处理文本。这家初创公司把这比作编辑一次性修改整个草稿,而不是只看单个单词。

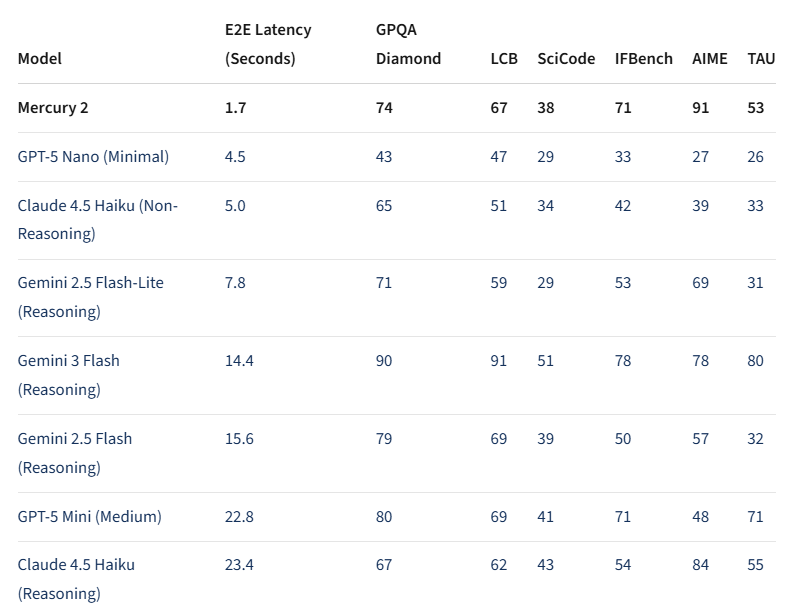

目前最明显的优势是速度和价格。据《盗梦空间》报道,Mercury 2在Nvidia Blackwell GPU上达到每秒1009个令牌,端到端延迟仅为1.7秒,而启用推理功能时,Gemini 3闪存为14.4秒,Claude Haiku 4.5为23.4秒。公司声称其输出质量可与领先的速度优化型号媲美。

定价为每百万输入代币0.25美元,每百万输出代币0.75美元,比Gemini 3 Flash(0.50美元/3.00美元)在输入价低一半,输出价低四倍,输入价约为Claude Haiku 4.5(1.00美元/5.00美元)的四倍,输出价超过两倍半。

该模型支持128K上下文窗口、工具使用和JSON输出。Inception的目标是拥有延迟敏感应用的公司,如语音助手、编程工具和搜索系统。

Mercury 2 现已通过兼容 OpenAI 的 API 提供。公司可以申请抢先体验,模型也可以直接在聊天中进行测试。

人工智能行业正在寻找变形金刚之后的未来

去年11月,Inception从包括Microsoft、Nvidia和Snowflake在内的投资者那里筹集了5000万美元。该初创公司于2025年初展示了首个原型。随着水星2号的推出,盗梦空间现已推出具备推理能力的量产机型。

Google Deepmind也在开发基于扩散的语言模型。Gemini Diffusion在基准测试中表现与当时的Gemini 2.0 Flash Lite模型相当。然而,自2025年5月首次展示扩散实验以来,谷歌尚未对该扩散实验发表任何声明。

更广泛地说,越来越多的初创公司正在探索替代主流变压器架构的方案。基于扩散的语言模型能否长期维持,仍是一个未知数。