Meta的新图像分割模型能够识别物体和人物并重建为3D

Meta平台公司今天,Meta扩展了其开源的Segment Anything计算机视觉模型套件,推出了SAM 3和SAM 3D,增强了物体识别和三维重建功能。

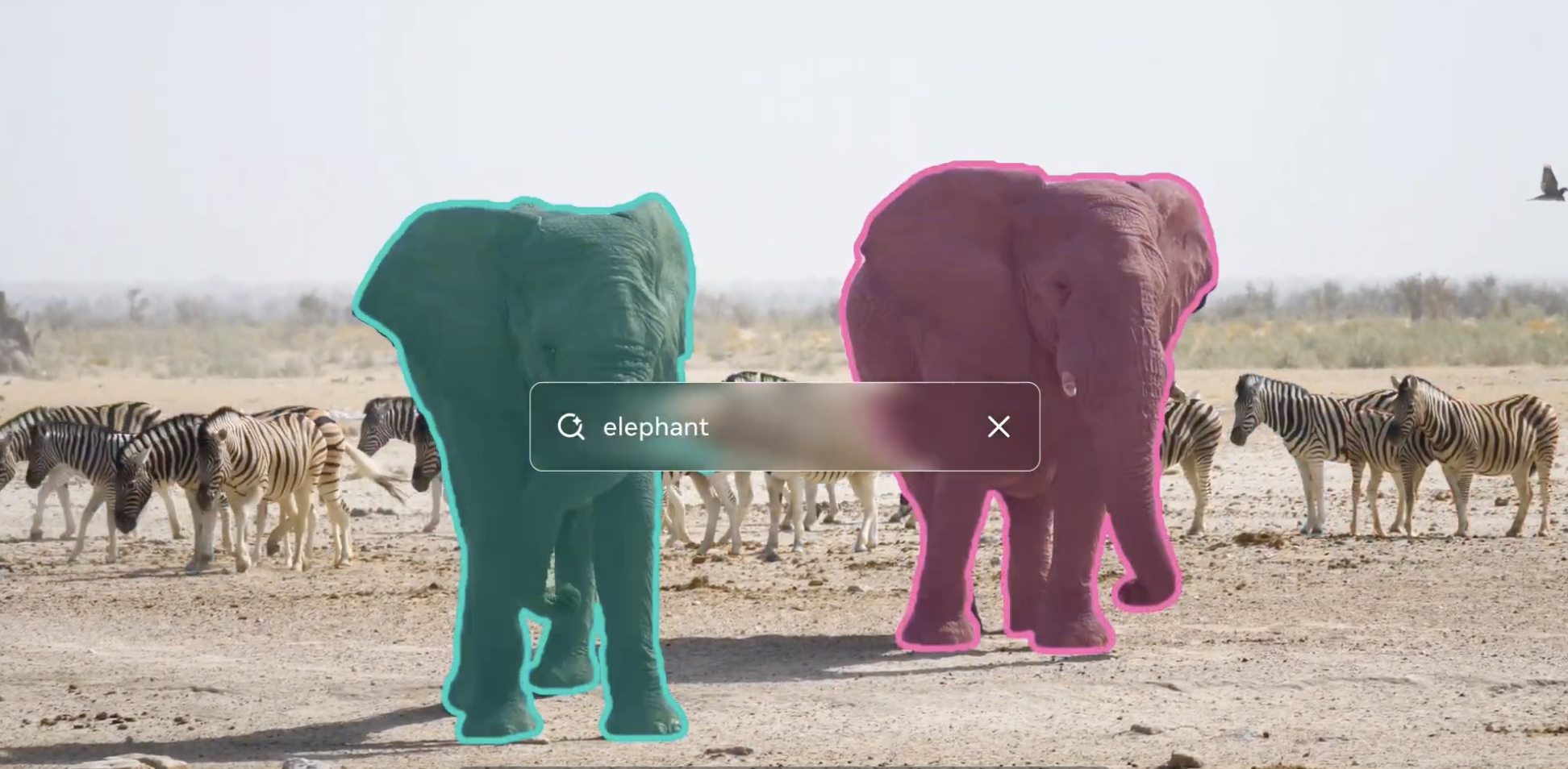

Meta表示,完整名称为Segment Anything 3的模型能够通过文本提示检测和跟踪图像和视频中的物体,而SAM 3D可以生成任何输入图像中物体或人物的极其逼真的3D版本。

SAM 3和SAM 3D被称为“图像分割”模型。分割是计算机视觉的一个子集,旨在教导算法识别图像或视频中的特定物体。它被广泛应用于分析卫星图像和编辑照片等领域。

Meta被广泛视为图像分割领域的领导者,早在原始的Segment Anything模型于2023年4月首次亮相,并伴随着一个包含数百万物体图像的大型数据集,以支持开源人工智能研究社区。

物体识别的突破

SAM 3在原始SAM模型的基础上进行了改进。Meta声称在检测、分割和跟踪图像和视频中的单个物体方面具有更高的准确性。该模型还支持通过详细的文本提示对这些物体进行转换,因此用户可以描述他们想要分割的图像中的特定物体,以及他们希望如何编辑它。例如,人们可以上传一张自己穿着蓝色衬衫的照片,并要求模型将其更改为红色衬衫。

Meta声称这是一个重大进步。它表示,AI模型长期以来一直难以将自然语言输入与图像和视频中的特定视觉元素联系起来。尽管大多数模型可以分割诸如“公交车”或“汽车”之类的简单概念,但它们通常仅支持有限的文本标签集,这意味着它们并不总是理解更复杂的描述,例如“黄色校车”。

Meta表示,SAM 3克服了这些限制,可以支持更广泛的描述范围。如果有人输入“红色棒球帽”,模型将分割出图像或视频中找到的所有匹配物体。此外,它可以与多模态大型语言模型结合使用,以理解更长的提示,例如“坐着的人,但不戴红色棒球帽”。

据Meta称,SAM 3可以为照片和视频编辑应用程序以及创意媒体带来众多可能性。它正在其新的AI视频创作应用Edits中试验该模型,并计划引入用户可以应用于视频中特定物体和人物的新特效。此外,它将把SAM 3引入Vibes,一个类似TikTok的平台,用于创建短视频和AI生成的视频。

重建物体和人类

至于SAM 3D,它将SAM 3的图像分割能力进一步扩展,不仅识别,还重建它识别的物体、人和动物的三维形态。例如,如果有人有一张已故祖父的照片,他们将能够使用SAM 3D重建他的3D形象,然后将其导入视频或虚拟现实世界中,公司表示。

SAM 3D由两个不同的模型提供支持,包括支持物体和场景重建的SAM 3D Objects,以及通过仔细估计其身体形状和体型来重建人类的SAM 3D Body。

Meta认为SAM 3D在机器人技术、科学和运动医学等领域具有重大影响,以及创意应用场景。例如,它可以支持基于现实世界物体和人物创建3D虚拟世界和增强现实体验,或为视频游戏创建新资产。公司表示,它还在AI支持的3D建模中有应用。

一如既往,Meta正在使用SAM 3D来启用Facebook Marketplace上的新“房间视图”功能。当有人浏览家居装饰物品如灯、桌子或椅子时,他们将能够在购买前模拟它在自己客厅中的样子。

这两个模型都可以在Meta的新Segment Anything Playground中访问,公司表示不需要专业知识即可开始使用。用户可以上传图像或视频,然后输入提示以剪切出不同的物体。例如,他们可以使用SAM 3D从不同的角度查看场景,并虚拟地重新排列或添加诸如运动轨迹之类的特效。

Meta正在与研究社区分享SAM 3,提供模型权重及其代码。它还发布了一个新的评估基准和开放词汇分割数据集,以及一篇描述如何构建新模型的研究论文。

SAM 3D尚未完全开源,但Meta表示将分享模型检查点和推理代码,这些将与新的3D重建基准一起发布。还有一个广泛的数据集,包含各种不同的图像和物体,用于训练目的。