百度最新ERNIE模型为开源AI带来视觉推理

百度推出了 ERNIE-4.5-VL-28B-A3B-Thinking,这是一种新的人工智能模型,可以处理图像作为其推理过程的一部分。

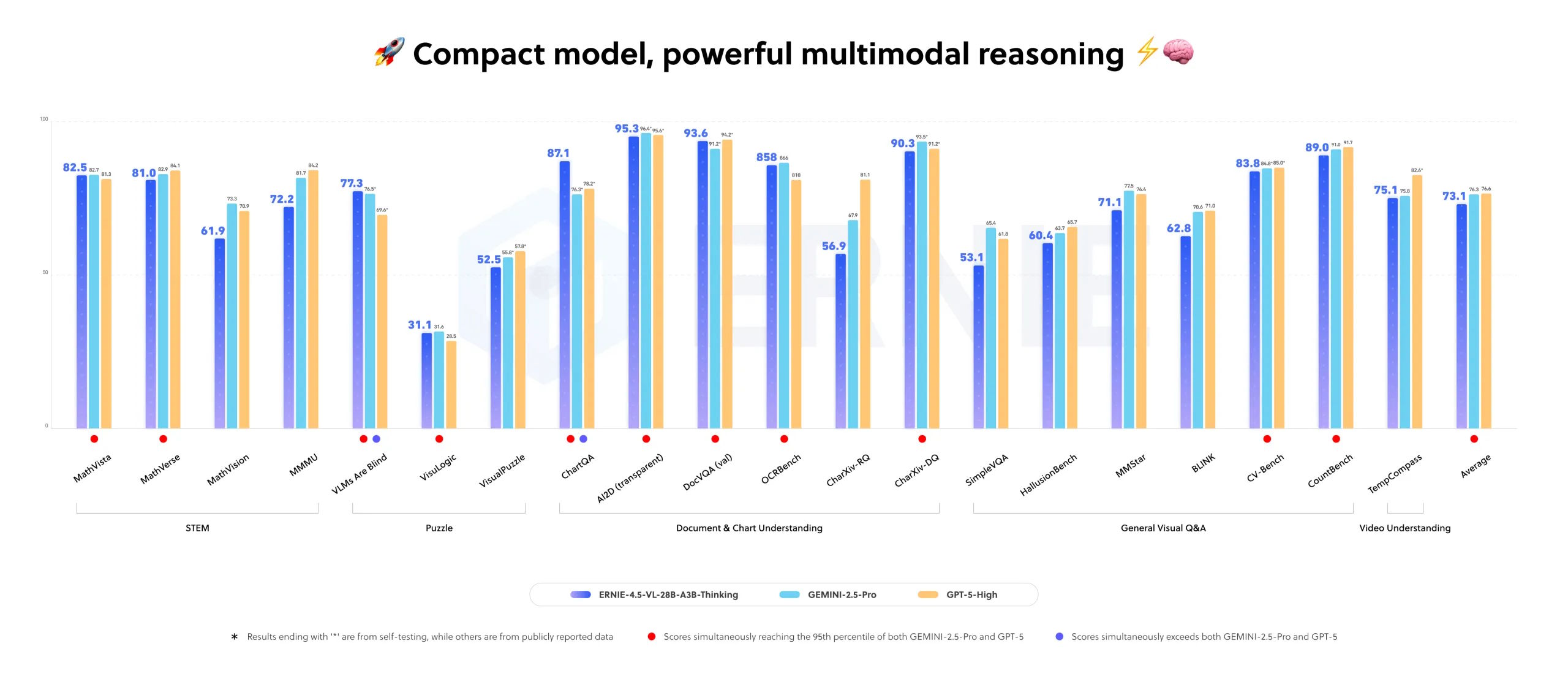

该公司声称,在多个多模式基准测试中,其表现优于 Google Gemini 2.5 Pro 和 OpenAI GPT-5 High 等大型商业模型。尽管仅使用了 30 亿个活动参数(由于路由架构,总共为 280 亿个),但该模型提供了强大的结果,并在单个 80 GB GPU(例如 Nvidia A100)上运行。

ERNIE-4.5-VL-28B-A3B-Thinking 是在 Apache 2.0 许可下发布的,因此可以免费用于商业项目。其报告的性能尚未得到独立验证。

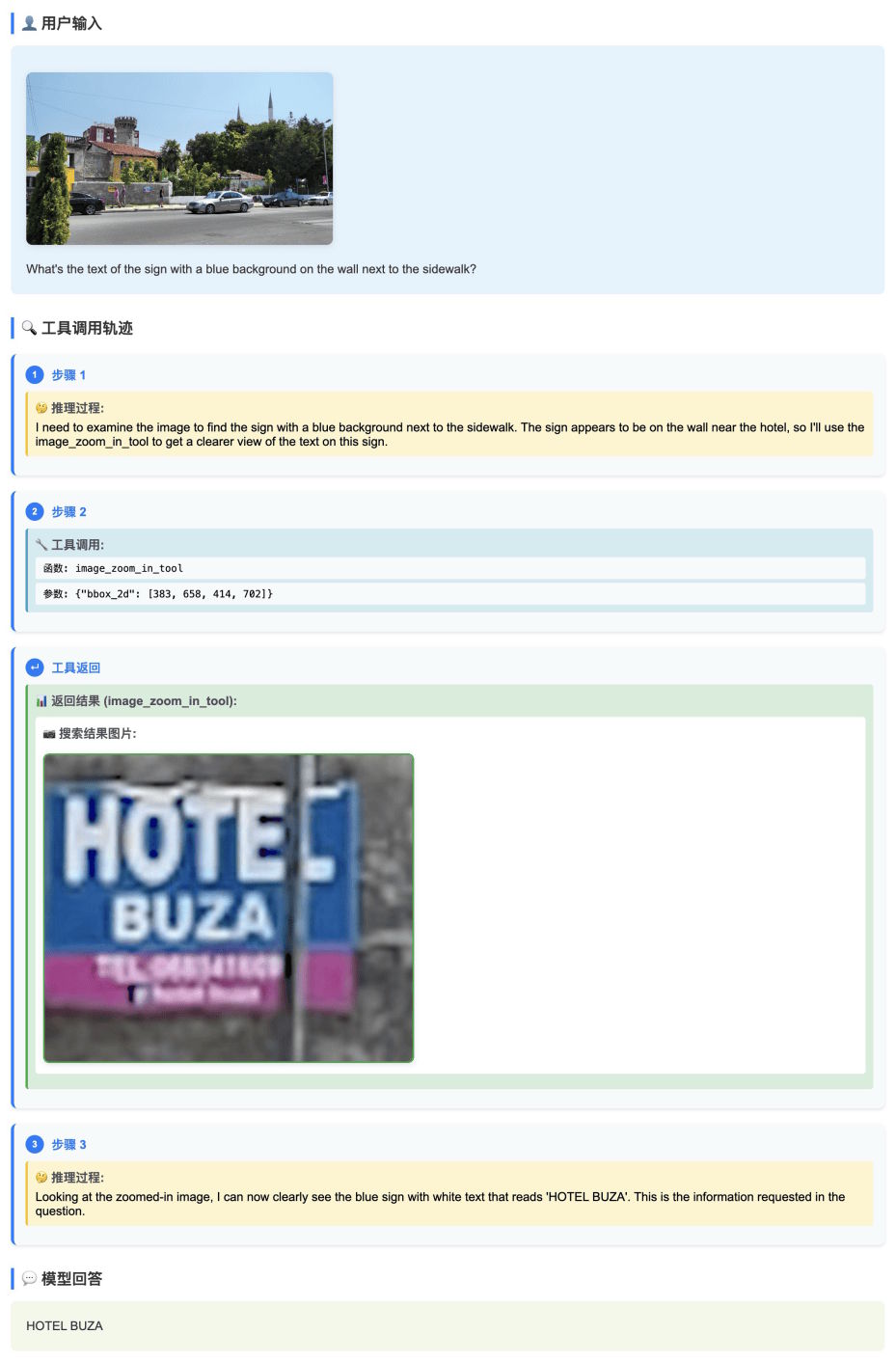

该模型的“用图像思考”功能使其可以动态裁剪图像以专注于关键细节。在一个演示中,ERNIE-4.5-VL-28B-A3B-Thinking 自动放大蓝色标志并识别其文本。

其他测试表明,它可以精确定位图像中的人物并返回他们的坐标,通过分析电路图解决数学问题,并根据图表推荐最佳访问时间。对于视频输入,它可以提取字幕并将场景与特定时间戳匹配。该模型还可以访问基于网络的图像搜索等外部工具来识别不熟悉的对象。

尽管百度强调了 ERNIE-4.5-VL-28B-A3B-Thinking 在其推理过程中裁剪和处理图像的能力,但这种方法并不是全新的。2025 年 4 月,OpenAI 在其 o3 和 o4-mini 模型中推出了类似的功能,这些模型可以将图像直接集成到其内部思维链中,并在完成视觉任务时使用缩放、裁剪和旋转等本机工具。这些功能有助于为类代理推理和解决问题设定新的基准。

现在引人注目的是,这些以前仅限于西方专有模型的尖端视觉推理功能也开始出现在开源的中国模型中,距离它们在西方人工智能系统中首次亮相仅几个月。