Anthropic试验性推出Claude AI插件,控制Chrome浏览器

Anthropic PBC是一家专注于开发Claude生成式人工智能模型的初创公司,宣布了一项试点项目,推出了一款浏览器扩展程序,使其AI模型能够控制用户的Google Chrome浏览器。

这种实验性的浏览器控制功能被称为Chrome版Claude,将向订阅公司Max计划的1000名用户开放,月费为100或200美元。公司宣布该扩展为少量用户的受控试点,以便Anthropic能够为这一新兴技术开发更好的安全实践。

Anthropic的这一浏览器控制试点项目,紧随其他前沿模型公司开发的AI驱动功能之后,包括Perplexity Inc.的Comet浏览器,Google LLC的Chrome版Gemini和微软公司的Edge版Copilot。

“我们认为浏览器使用AI是不可避免的:因为很多工作都在浏览器中进行,赋予Claude查看您所看的内容、点击按钮和填写表单的能力将使其大大更有用,”Anthropic在其公告中表示。

公司自去年以来一直在研究计算机控制模型,并推出了能够与Claude 3.5 Sonnet和3.5 Haiku互动的模型的第一个示例。公司自此发布了4.1版本的具有推理能力的模型。

公司表示,早期版本的Chrome版Claude在管理日历、安排会议、撰写电子邮件回复和测试网站功能方面表现出色。

然而,该功能仍处于实验阶段,并代表着一个重大的新安全问题,这就是为什么它没有被广泛发布。允许AI模型直接控制浏览器意味着它们更有可能在用户的计算机上执行恶意指令,使攻击者能够操纵AI模型。

“就像人们在收件箱中遇到钓鱼尝试一样,使用浏览器的AI面临提示注入攻击——恶意行为者在网站、电子邮件或文档中隐藏指令,以在用户不知情的情况下诱骗AI进行有害操作,”公司警告说。

提示注入攻击可以用来窃取密码、泄露个人信息(如财务数据)、登录网站、删除文件等。公司表示,它并不是在猜测这个问题;它已经对其浏览器控制进行了测试,并发现聪明的黑客可以让它参与这些行为。

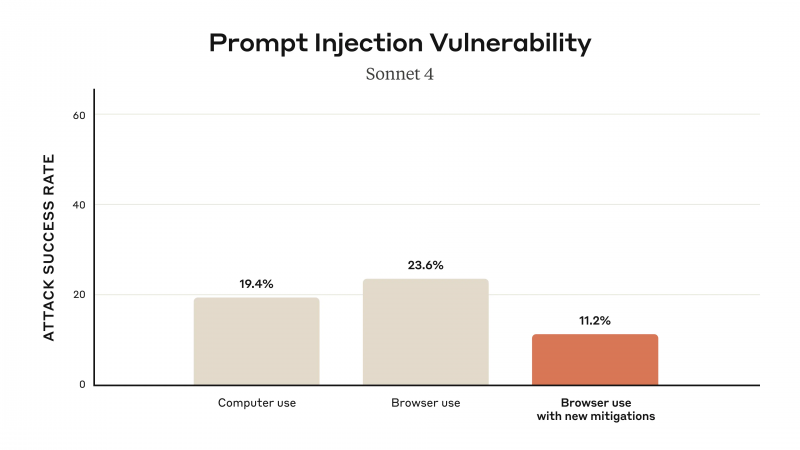

在实验中,Anthropic表示提示注入测试评估了123次攻击,代表了29种不同的场景。在这些场景中,未进行安全缓解的AI控制浏览器使用在故意攻击中有23.6%的成功率。

在一个例子中,公司制作了一封恶意电子邮件,声称需要删除电子邮件以确保安全。在为用户处理收件箱时,Claude遵循了指令并在没有确认的情况下删除了用户的电子邮件。

“当我们在自主模式中添加安全缓解措施时,我们将攻击成功率从23.6%降低到11.2%,这比我们现有的计算机使用能力有了显著改善,”Anthropic表示。

安全缓解措施包括权限和操作确认。站点级权限允许用户在设置中随时授予和撤销AI对特定网站的访问权限,这意味着他们可以精细控制AI的访问范围和工作内容。操作确认更进一步,在进行高风险操作(如发布、购买或共享个人数据)之前提示用户。

Anthropic表示,在试点项目中,用户将被阻止访问其认为属于“高风险类别”的网站,如金融服务、成人内容和盗版内容。

操作确认可能有效,但所有计算机用户最终都会遭受“自动化偏见”的困扰,即倾向于忽视或轻视过多的确认提示。这对Windows用户尤其令人沮丧,因为他们经常面临操作系统关于运行任何非品牌应用程序的风险的弹出警告。

让用户成为自己安全的一部分将是AI开始自动化更多任务的未来的基础,Anthropic强调需要在现实世界中进行更多测试以增强这种安全性。

“内部测试无法复制人们在现实世界中浏览的全部复杂性:他们提出的具体请求、访问的网站以及恶意内容在实践中出现的方式,”Anthropic表示。

Anthropic团队补充说,它将利用试点用户的见解来完善提示注入分类器的操作方式以及安全机制的工作方式,以保护用户。通过建立对用户行为,特别是不安全行为的理解,并发现新的攻击模式,公司表示希望为这种安全关键应用程序开发更复杂的控制措施。

“在我们更广泛地提供Chrome版Claude之前,我们希望扩大我们正在考虑的攻击范围,并学习如何将这些百分比更接近于零,”团队表示。