微软推出图像模型 MAI-Image-2-Efficient

Microsoft公司推动人工智能独立性的努力正在随着今日发布的MAI-Image-2-Efficient而获得关注,这是其旗舰图像生成模型的精简且高效的版本,该模型于本月初首次亮相。

公司表示,新版本旨在更快提供高质量的画面,且成本仅为前代的一小部分。最初的MAI-Image-2模型由Microsoft新成立的MAI超级智能团队于本月初发布,而由Mustafa Suleyman领导的团队在几周后推出了该模型的简化版本,因此获得了认可。

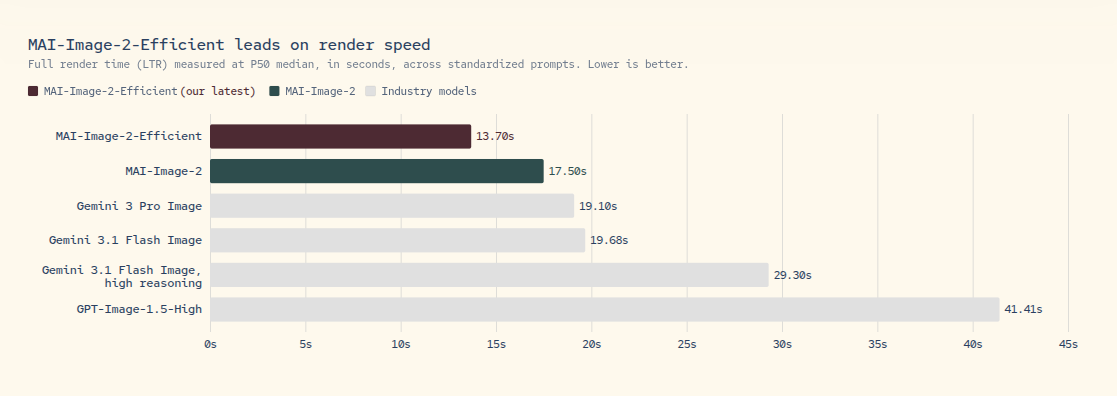

顾名思义,MAI-Image-2-Efficient的核心就是效率,Microsoft承诺在Nvidia公司的H100处理器上运行时,每台图形处理单元的吞吐量将提升四倍。就原始性能而言,它比主型号MAI-Image-2快约22%,超过了谷歌有限责任公司(Google LLC)延迟高出40%的Gemini 3.1 Flash,谷歌援引自家基准测试。

Microsoft表示,MAI-Image-2-Efficient的性价比也更高,起价为每百万个输入代币5美元,与旗舰型号相同,每百万个输出代币为19.50美元,成本降低41%。这种两层定价策略,用户可以在高端高保真创意模式和高效批量生产模式之间选择,这与谷歌及OpenAI集团PBC和Anthropic PBC等初创公司的策略相呼应。公司表示,MAI-Image-2-Efficient特别适合“装配线”任务,如用户界面模型、产品摄影和营销资源,这些工作中每张图片的成本是关键考虑因素。

对原版MAI-Image-2的早期反馈积极,该模型在Arena.ai排行榜上排名第三,并因其逼真的写实性和复杂字体渲染能力而获得赞誉——这是许多其他图像生成模型难以实现的领域。但目前尚不清楚MAI-Image-2-Efficient是否也面临与其兄弟一样令人恼火的限制。例如,原作因提示之间有30秒的“冷却”时间、无法生成除1:1以外的图片比例以及过于激进的内容过滤而受到大量批评。

Microsoft推动开发自有模型的动力是减少对OpenAI的依赖,而多年来它在OpenAI上投入了大量资金。曾几何时,这家Windows软件制造商几乎完全依赖OpenAI的模型来开发其AI产品和能力。但似乎对被一家日益强大的公司“锁定”持谨慎态度,而该公司也表现出独立性的意愿。

就在昨天,CNBC报道称,他们曝光了OpenAI新任首席营收官Denise Dresser的一份内部备忘录,其中告诉员工,公司与Microsoft的合作“也限制了我们与企业实际接触的能力。”备忘录指出,OpenAI与亚马逊网络服务公司(Amazon Web Services Inc.)旗下Bedrock平台的新合作是增长的关键推动力,并指出自2月宣布合作以来,入站需求“坦率地说,令人震惊”。

OpenAI还试图将其云基础设施多元化,包括CoreWeave Inc.、Google LLC和Oracle Corp.等供应商,而Microsoft则承担起了风险。Microsoft则于2024年中期将OpenAI加入官方竞争对手名单。

与此同时,Valoir分析师Rebecca Wettemann在一月份讲到,Microsoft对OpenAI的依赖正成为投资者的重大担忧,因为OpenAI正面临来自谷歌和Anthropic等竞争对手的激烈竞争。“投资者正在失去耐心,主要原因是Microsoft最终可能的回报很大程度上依赖于OpenAI带来的资金,而这目前大多是假设性,”她解释道。

开发自己的模型对Microsoft来说可能更有利可图。MAI模型现在成为用户要求公司Copilot工具生成图像时的默认选项,取代了OpenAI的DALL-E模型。这意味着Microsoft可以将所有产生的成本留给自己,而无需向OpenAI支付许可费。

MAI-Image-2-Efficient也有助于加速Microsoft的代理型AI战略。随着Copilot Cowork和Agent 365等服务的推出,Microsoft正迈向一个人工智能代表用户执行复杂多步骤任务和工作流程的世界。如果一个自主代理被要求为新的营销活动开发材料,低延迟和降低成本是必不可少的,使其能够大规模迭代。

Microsoft表示,MAI-Image-2-Efficient现已通过Microsoft Foundry和MAI Playground提供。