谷歌的 Gemma 4 现已推出,并且首次采用 Apache 2.0 开源许可协议

谷歌发布了Gemma 4,这是其迄今为止最强大的开放型号家族。这四款新型号可运行于智能手机到工作站等多种平台,并首次采用完全开放的Apache 2.0许可发布。

这些模型基于与谷歌专有的Gemini 3相同的技术,并以商业许可的Apache 2.0许可证发布,赋予开发者对其数据、基础设施和模型的完全控制权。早期的Gemma版本采用了更严格的谷歌专有许可协议。

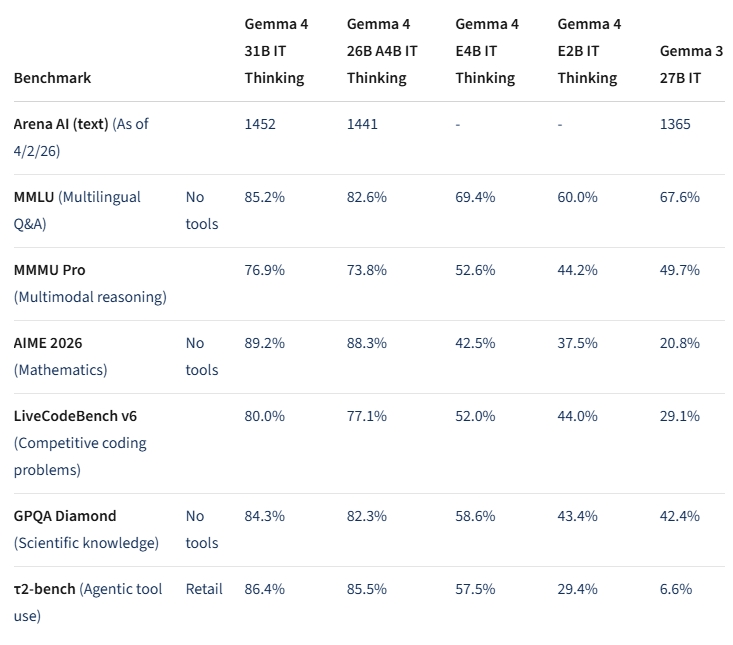

据谷歌称,所有Gemma 4模型在多步推理和数学任务方面都有显著提升。对于代理型工作流,它们原生支持函数调用、结构化JSON输出和系统指令,使自主代理能够调用各种工具和API。

四种型号尺寸涵盖从边缘设备到工作站的各种设备

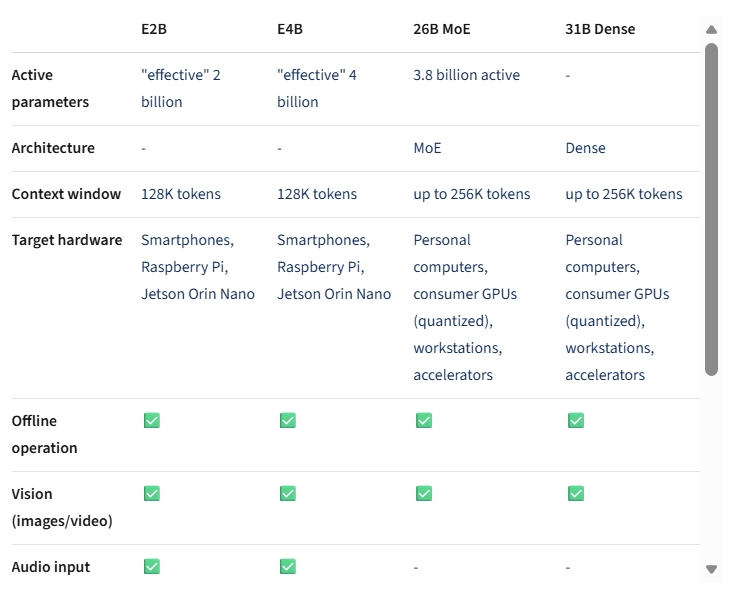

Gemma 4 有四个规模:有效 2B(E2B)、有效 4B(E4B)、26B 专家混合模型(MoE)和 31B 密集模型。这四个都超越了简单的聊天,处理复杂的逻辑和代理式工作流程。

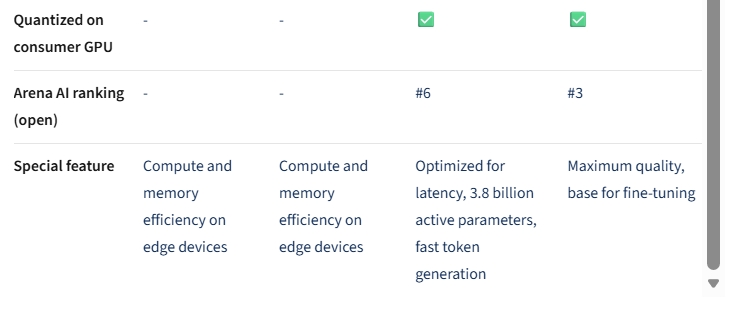

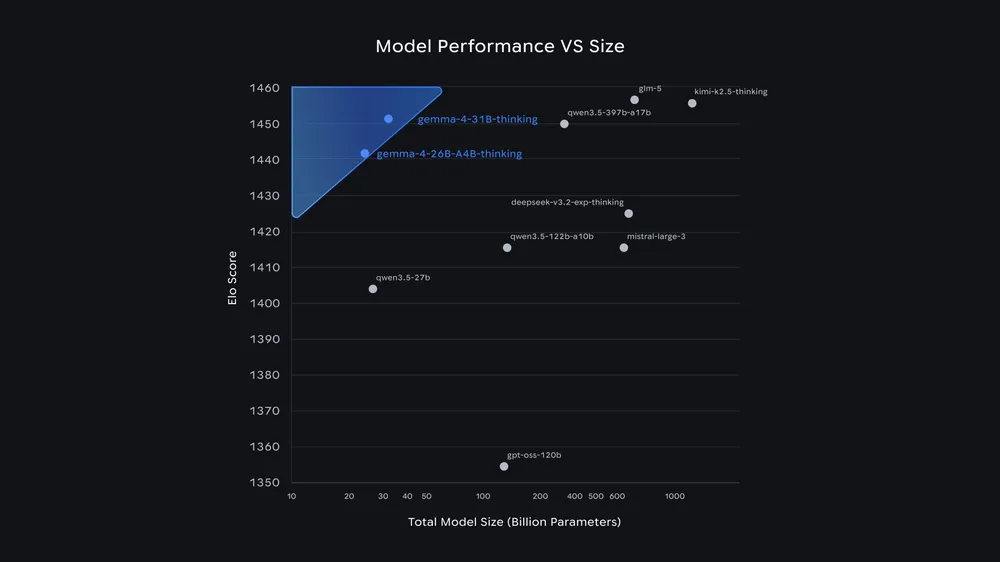

31B型号目前在全球Arena AI文本排行榜中位列全球开放模型第3位,而26B模型则排名第6。谷歌表示,Gemma 4的表现优于其体积20倍的模型。对开发者来说,这意味着高性能表现显著降低硬件需求。

两款较大的型号主要面向工作站和服务器。31B型号的未量化bfloat16权重可以安装在一块80GB的NVIDIA H100显卡上,量化版本也能运行在消费级显卡上。

260亿MoE模型在推理过程中仅激活38亿参数,这使得代币生成速度特别快。31B密集模型则旨在追求最高质量,旨在作为微调的基础。

较小的E2B和E4B型号专为移动设备和物联网硬件设计。它们分别在推理过程中激活20亿和40亿参数,以节省内存和电池寿命。这两种边缘模型都原生处理图像、视频和音频输入以实现语音识别。它们的上下文窗口涵盖128,000个代币,而较大的模型则可处理多达256,000个代币。

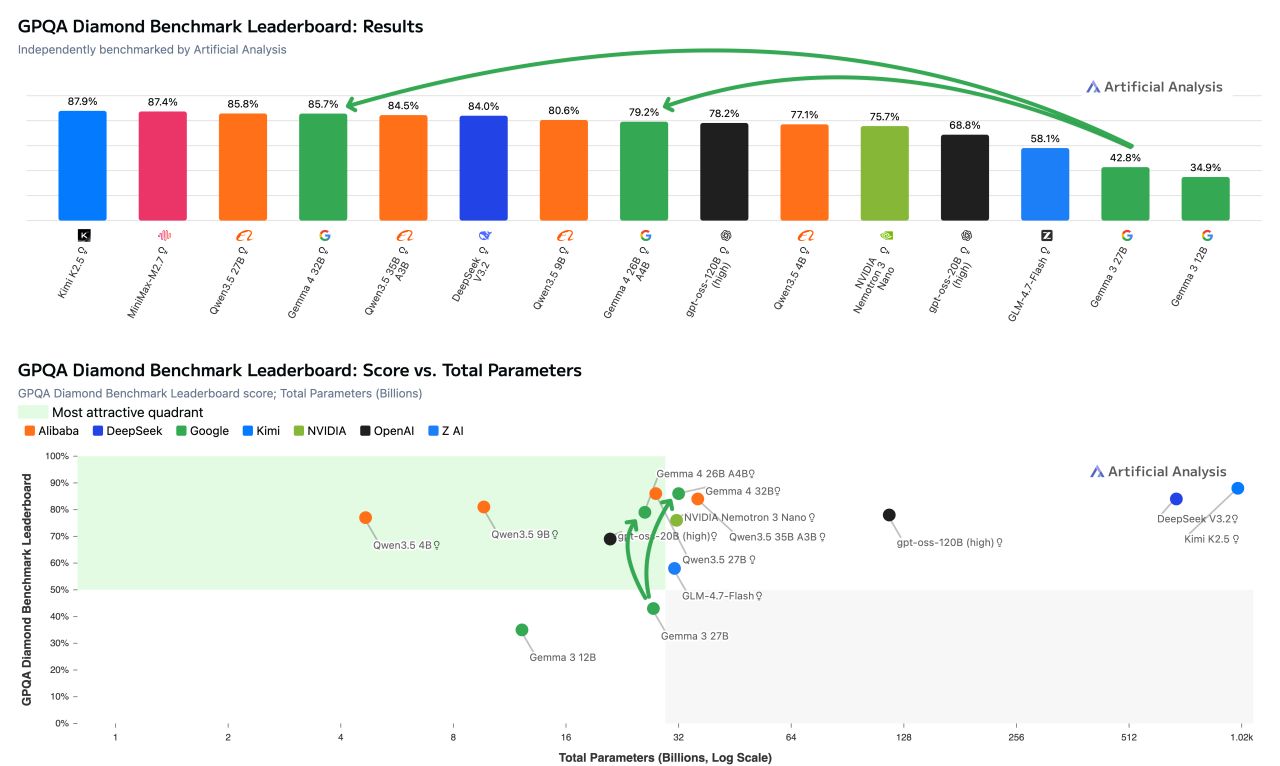

Artificial Analysis的独立基准数据支持了大型Gemma 4型号的数据。在GPQA Diamond科学推理基准测试中,Gemma 4 31B在推理模式下得分为85.7%。根据Artificial Analysis的数据,这是所有参数少于400亿的开放模型中第二好的成绩,仅次于Qwen3.5 27B的85.8%。在约120万个输出令牌上,Gemma 4 31B可能也比Qwen3.5 27B(150万个)和Qwen3.5 35B A3B(160万个)需要的计算量更少。

26B MoE 模型在同一基准测试中得分为 79.2%,领先于 OpenAI 的 gpt-oss-120B(76.2%),但落后于 Qwen3.5 9B(80.6%)。Artificial Analysis指出,这两款被评估的型号都运行在一块H100 GPU上。人工智能指数中四个Gemma 4模型的完整评估仍在等待中。一如既往,基准数据在预测实际性能方面有限。

Gemma 4 在哪里可以买到以及它支持哪些平台

《Gemma 4》现已在Hugging Face、Kaggle和Ollama上线。Google AI Studio 支持 31B 和 26B 型号,而 Google AI Edge Gallery 则处理 E4B 和 E2B 变体。

发布时,这些模型支持多种框架和平台,包括 Hugging Face Transformers、vLLM、llama.cpp、MLX、Ollama、NVIDIA NIM 和 NeMo、LM Studio、Unsloth、SGLang、Keras 等。微调可以通过Google Colab、Vertex AI或本地游戏GPU进行。对于生产部署,模型通过Vertex AI、Cloud Run和GKE扩展到Google Cloud。

在硬件方面,谷歌表示Gemma 4支持从Jetson Orin Nano一直到Blackwell GPU、通过ROCm协议栈的AMD显卡,以及谷歌自家的Trillium和Ironwood TPU硬件。