Google Deepmind 赋予 Gemini 3 Flash 通过代码主动探索图像的能力

Google Deepmind正在为其Gemini 3 Flash模型新增一项名为“代理视觉”的功能。模型不再被动地查看图像,而是可以主动调查图像——尽管并非所有特征都会自动工作。

传统的AI模型在一次处理中处理图像。如果他们漏掉了细节,就只能靠猜测。Google Deepmind希望通过Agentic Vision来改变这一点。模型现在可以通过生成和运行 Python 代码,逐步缩放、裁剪和作图像。

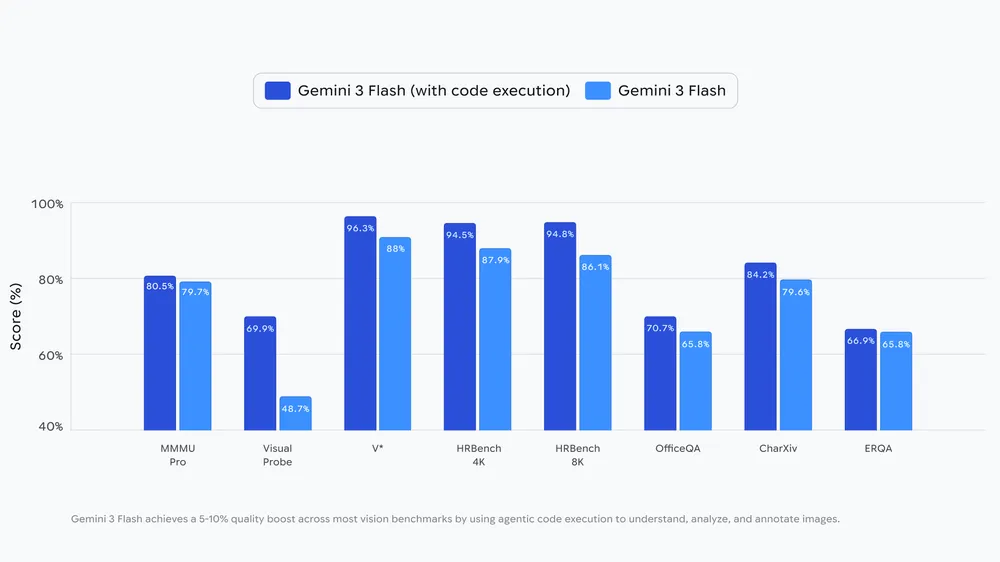

该系统通过思考-行动-观察循环运作。模型首先分析请求和图像,然后制定计划。接下来,它生成并执行 Python 代码——例如用于裁剪、旋转或注释图像。结果会被添加到上下文窗口,让模型在响应前检查新数据。据谷歌称,代码执行在各种视觉基准中带来5%到10%的质量提升。

不过,这个概念并非全新——OpenAI通过其o3模型引入了类似的功能。

蓝图分析初创公司报告准确性提升

作为一个现实世界的例子,谷歌举例来说,PlanCheckSolver.com 是一个检查施工蓝图合规性的平台。这家初创公司表示,通过让Gemini 3 Flash迭代检查高分辨率图纸,其准确率提高了5%。模型裁剪屋顶边缘或建筑剖面等区域,并逐一分析。

对于图像注释,模型可以在图像上绘制边界框和标签。谷歌通过手指计数演示了这一点——模型在每根手指上用一个框和数字标记,以避免计数错误。

对于视觉数学问题,模型可以在Python环境中解析表格并运行计算,而不是产生幻觉结果。然后它可以将结果输出为图表。

许多功能仍然需要明确的指令

谷歌承认并非所有功能都能自动运行。虽然模型已能自行处理细节放大,但旋转图像或视觉数学等功能仍需明确提示。公司计划在未来更新中解决这些限制。

Agentic Vision目前也仅限于Flash模型。谷歌表示计划扩展到其他型号尺寸,并增加网页搜索和反向图片搜索等工具。

Agentic Vision 可通过 Google AI Studio 和 Vertex AI 中的 Gemini API 使用。Gemini应用已开始推广——用户可以在模型下拉菜单中选择“思考”。还提供演示应用和开发者文档。