DeepSeek开发mHC AI架构以提升模型性能

DeepSeek的研究人员开发了一种名为Manifold-Constrained Hyper-Connections(简称mHC)的技术,旨在提升人工智能模型的性能。

这家中国AI实验室首次推出了这款软件。相关论文已于周三发表。

DeepSeek创建mHC是为了增强大型语言模型中用于学习新信息的残差连接机制。该机制于2015年发明,并被许多视觉模型采用。尽管DeepSeek并不是第一个尝试改进残差连接的市场参与者,但早期的尝试结果喜忧参半。

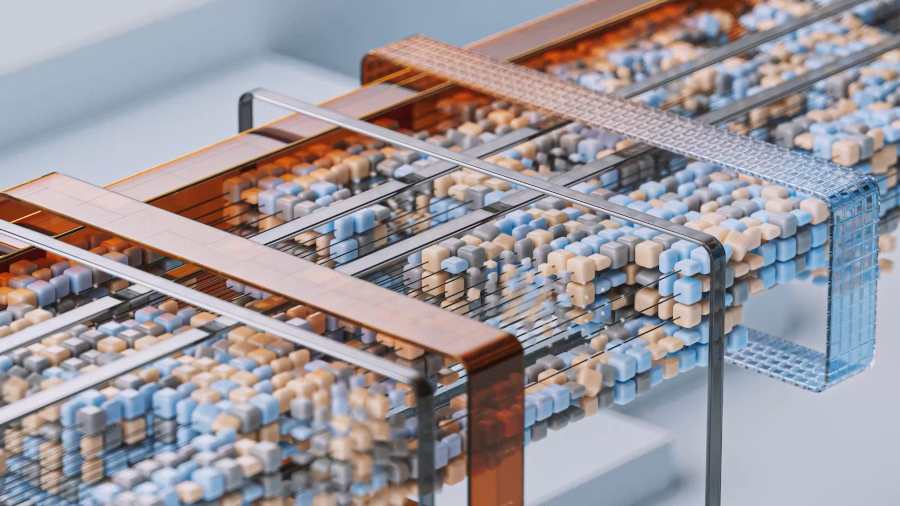

一个AI模型由许多称为层的软件组件组成。当用户输入一个提示时,文本进入第一层,执行生成提示响应所需计算的一小部分。第一层将其计算结果发送到第二层,第二层完成另一部分工作,并将结果传递给第三层,依此类推。最后一层输出对用户问题的答案。

在AI训练过程中,最后一层起着关键作用。如果模型输出了错误的提示响应,最后一层会收到一个称为梯度的信号。梯度表明AI犯了错误,并包含有关模型如何改进的信息。梯度从最后一层开始,向后穿过AI的其余结构,直到到达第一层。

2015年,研究人员发明了一种梯度管理机制,称为残差连接。这是一种快捷方式,使梯度可以直接在两个远距离的AI层之间传递,而无需经过中间的所有层。残差连接减轻了几种常见的AI训练错误,因此在LLM和视觉模型中被广泛使用。

去年九月,研究人员推出了一种残差连接的替代方案,称为超连接。它解决了该机制的几个缺点,但也有其自身的局限性。DeepSeek本周推出的mHC架构是超连接的增强实现。它避免了与后者机制相关的几个技术挑战,使其更适合生产使用。

mHC的主要创新在于结合了所谓的流形。流形是一个广泛的数学对象家族,复杂性差异很大。有些流形是简单的几何形状,如圆形,而其他流形则跨越三个以上的维度。DeepSeek表示,mHC使用流形来保持梯度在AI模型层之间传递时的稳定性。

公司通过使用该架构训练了3个具有30亿、90亿和270亿参数的LLM来进行测试。然后,它使用超连接技术训练了另外三个具有相同参数数量的模型,mHC就是从这种技术中衍生出来的。根据DeepSeek的说法,mHC驱动的LLM在八个不同的AI基准测试中表现更好。

公司表示,该架构在硬件效率上也优于超连接。后者机制在训练期间显著增加了LLM的内存需求。在其内部测试中,DeepSeek确定mHC仅产生6.27%的硬件开销。

“通过加深对拓扑结构如何影响优化和表示学习的理解,mHC将有助于解决当前的局限性,并可能为下一代基础架构的演变开辟新的途径,”DeepSeek研究人员在mHC论文中写道。