Meta AI为移动设备开发紧凑型语言模型

Meta AI的研究人员发布了一种为智能手机和其他资源受限设备设计的高效语言模型的新方法——MobileLLM

研究团队由来自Meta Reality Labs、PyTorch 和 Meta AI Research(FAIR)的成员组成,他们专注于优化参数少于 10 亿的模型。这仅是像 GPT-4 这样估计拥有超过一万亿参数的模型大小的一小部分。

MobileLLM的关键创新包括:

1、优先考虑模型深度而非宽度

2、实现嵌入共享和分组查询注意力

3、采用新颖的即时块级权重共享技术

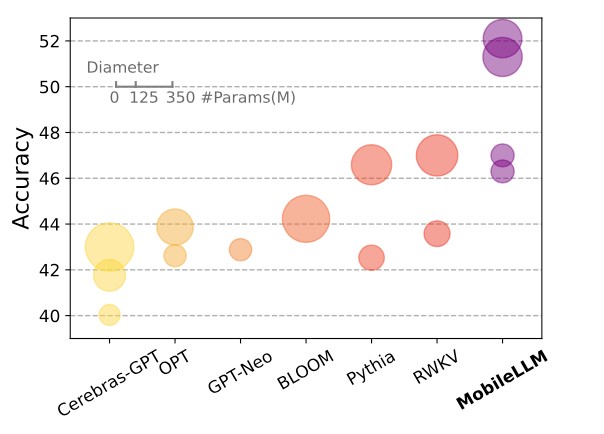

这些设计选择使得MobileLLM在常见的基准任务上,能够比先前同等大小的模型高出 2.7% 至 4.3% 的性能。尽管这些个位数的改进看似微小,但在竞争激烈的语言模型开发领域,它们代表了有意义的进步。

值得注意的是,MobileLLM 的 3.5 亿参数版本在某些 API 调用任务上的准确率与远大于其的 70 亿参数 LLaMA-2 模型相当。这表明,对于某些特定应用,更紧凑的模型可能在使用显著更少的计算资源的同时,提供类似的功能。

MobileLLM 的开发符合对更高效 AI 模型日益增长的兴趣。随着超大型语言模型的发展显现出放缓的迹象,研究人员越来越多地探索更紧凑、更专业设计的潜力。尽管其名称中包含“LLM”(大型语言模型),但 MobileLLM 对效率和设备端部署的关注使其与一些研究人员所称的小型语言模型属于同一类别。

虽然 MobileLLM 目前尚未向公众开放,但 Meta 已经开源了预训练代码,允许其他研究人员在此基础上进行开发。随着这项技术的发展,它可能会在个人设备上实现更高级的 AI 功能,尽管具体的时间表和能力尚不确定。

MobileLLM 的开发标志着使高级 AI 更加普及和可持续的重要一步。它挑战了有效语言模型必须庞大的观念,可能为个人设备上的 AI 应用开辟新的途径。