Tenyx突破性AI微调技术,超越GPT-4

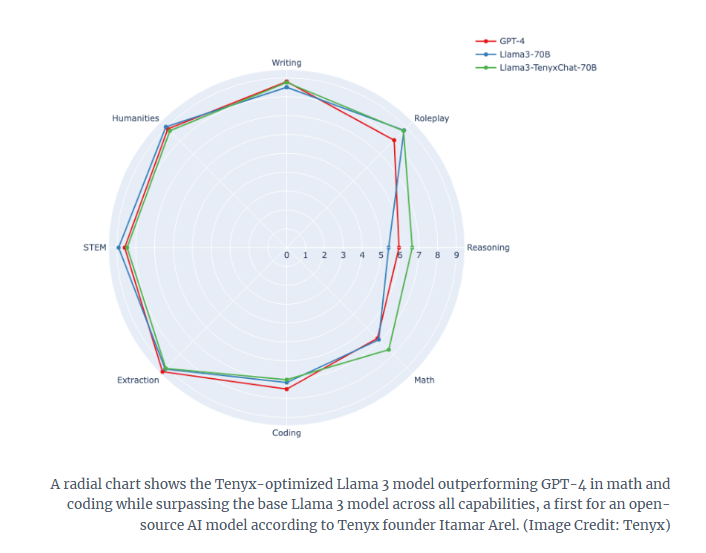

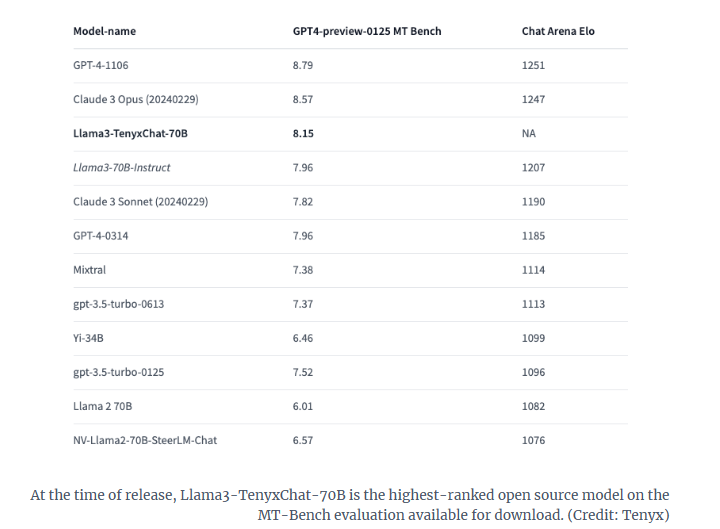

据报道,AI 初创公司 Tenyx 的创始人兼首席执行官 Itamar Arel 近日在自然语言处理领域取得了一项重要突破。Tenyx 成功地对 Meta 的开源 Llama-3 语言模型(现更名为 Tenyx-70B)进行了微调,使得其在某些领域超越了 OpenAI 的 GPT-4,这标志着开源模型首次超越了专有技术的标杆。

“我们开发了一种微调技术,能够让我们获取一个基础模型并对其进行优化或训练,从而超越其原始训练范围。”Arel 解释道。“我们对此技术感到非常兴奋,因为它允许我们充分利用大型模型中的冗余性,实现可能更好的持续学习或增量学习。”

克服“灾难性遗忘”

Tenyx 的新微调方法解决了“灾难性遗忘”的问题,即模型在接触新数据时可能忘记之前学到的知识。通过仅选择性地更新模型参数的一小部分,Tenyx 能够在不影响现有能力的前提下高效地训练模型以学习新信息。

“如果你最终只改变了大约 5% 的模型参数,而其他部分保持不变,你就可以更加积极地进行更新,而不会冒着扭曲其他事物的风险。”Arel 表示。这种选择性参数更新方法还使得 Tenyx 能够实现极快的训练时间,仅使用 100 个 GPU 在短短 15 小时内对拥有 700 亿参数的 Llama-3 模型进行了微调。

坚守开源AI的承诺

Tenyx 对开源 AI 的承诺体现在他们决定以与原始 Llama-3 相同的许可协议发布其微调后的模型,即 Tenyx-70B。“我们非常支持开源模型”Arel表示。“社区分享的进步越多,就越能催生出令人惊叹的应用,这对所有人来说都是更好的。”

Tenyx 的后训练优化技术具有广泛的应用前景,从为特定行业打造高度专业的聊天机器人,到使已部署的模型能够进行更频繁的增量更新,从而在主要版本发布之间保持最新信息。

重塑 AI 格局

Tenyx 的这一突破具有深远的意义,可能通过为企业和研究人员提供最先进的语言模型访问权限来平衡竞争环境,同时避免与专有产品相关的高成本和限制。这一发展还可能激发开源社区内的进一步创新,因为其他开发者会寻求在 Tenyx 的成功基础上进行构建。

“这不禁让人思考,这对行业意味着什么?对全球领先的 OpenAI 又意味着什么呢?”Arel 深思道。随着 AI 军备竞赛的持续升温,Tenyx 在微调开源模型方面的成就可能会重塑 AI 行业,并改变企业处理自然语言处理任务的方式。

尽管 Tenyx 优化的 Llama-3 模型继承了基础模型的一些限制,如偶尔出现不合理或毫无根据的回应,但其性能的提升是显著的。Arel 特别指出,该模型在数学和推理任务中取得了令人印象深刻的进步,准确率近 96%,而基础模型的准确率仅为 85%。

随着 Tenyx 为开源 AI 创新的新时代揭开了序幕,其突破对 AI 生态系统的影响仍待观察。但有一点是确定的:Tenyx 已经证明了开源模型可以与专有模型竞争,甚至超越它们,为人工智能领域更加开放和协作的未来奠定了坚实的基础。