Jupyter AI:快速原型设计的开源工具

介绍

在本文中,我将向你展示如何安装 Jupyter Lab IDE 以及快速原型开发环境所需的所有工具。你只需设置一次,我将一步步向你讲解。

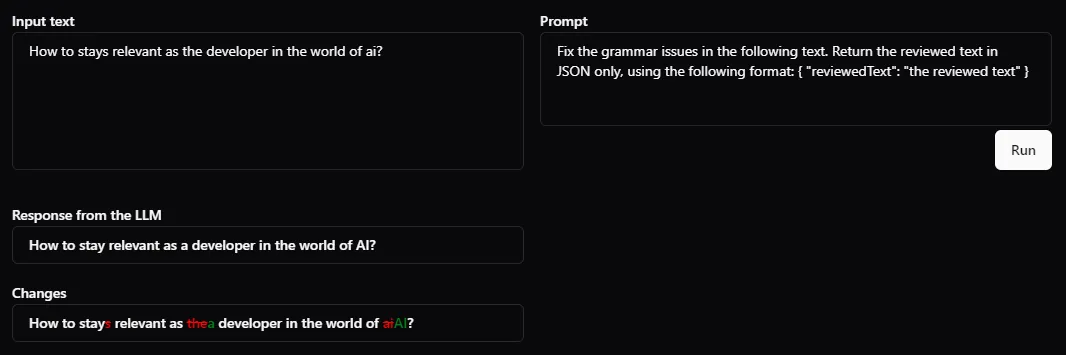

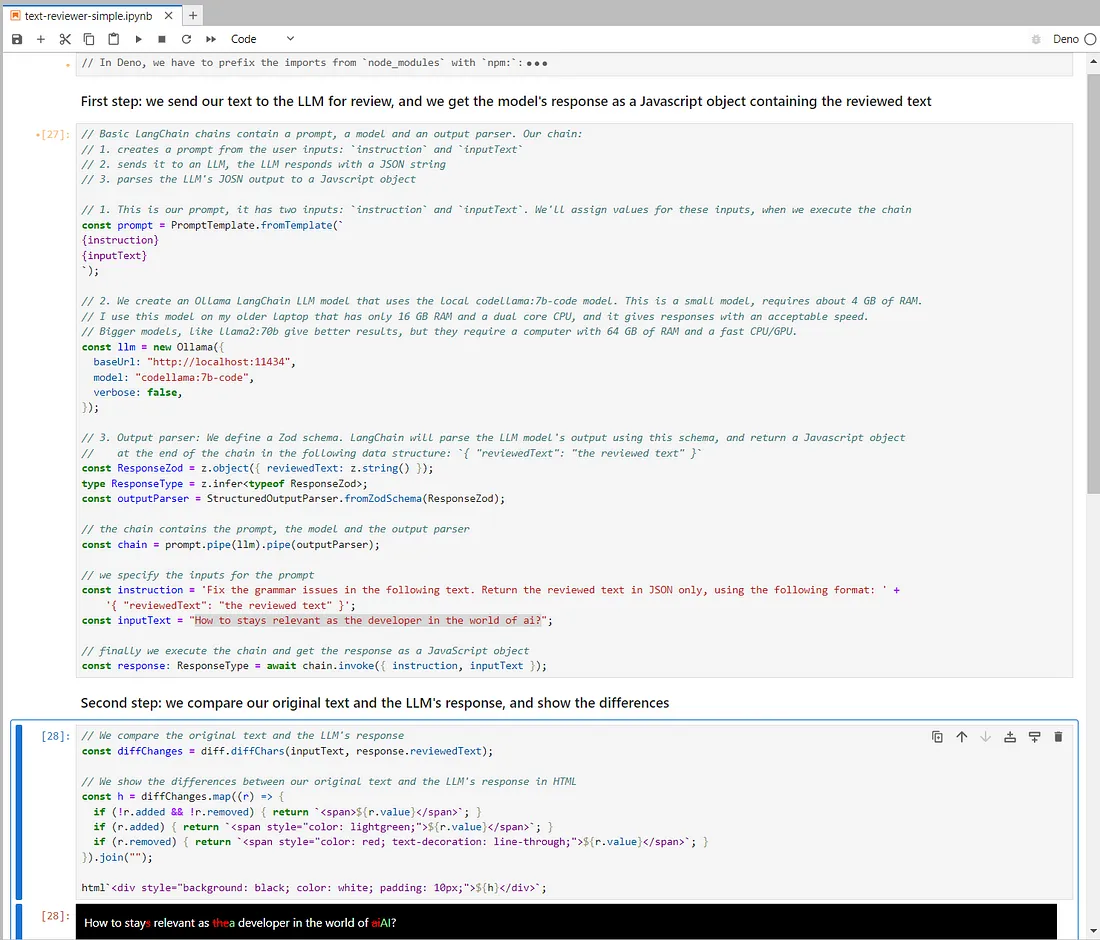

例如,我将向你详细介绍我是如何创建 "文本审阅器应用程序 ":

我的工作流程和工具

我使用以下工作流程开发人工智能工具:

- 基于 Typescript 和 Jupyter Lab 的人工智能工具原型开发环境,用于快速开发人工智能工具原型。

- 我扩展原型的代码,从中创建一个商店。在 React 应用程序中,我使用 Zustand React 商店;在 Angular 中,我使用 NgRx 的 SignalStore;在 Jupyter Lab 中,我使用 Zustand Vanilla 商店。这些存储解决方案有很多共同点,因此我可以重复使用相同的选择器、效果和更新器代码。

- 我在 Nx monorepo 中构建了一个使用商店的 Angular 或 React 应用程序或智能组件。我在 React 应用程序中使用 Shadcn UI,在 Angular 应用程序中使用基于 Shadcn 的 spartan/ui,因此我可以在 Angular 和 React 中使用几乎相同的应用程序架构。

这些是我基于 Typescript 的人工智能工具原型环境中最重要的工具:

- Jupyter Lab 基于网络的交互式开发环境

- 用于 Jupyter 笔记本的 Deno Typescript/Javascript 内核,它能让我们用 Typescript 创建 Jupyter 笔记本

- 用于本地运行 LLM 的 Ollama

- Langchain,一个开发由语言模型驱动的应用程序的框架

如果你按照本文的步骤操作,就能在本地 Jupyter Lab IDE(可下载的 Jupyter 笔记本)中运行 "文本审阅器应用程序 "原型,还能根据我的示例开始创建自己的应用程序原型:

设置: Chocolatey

安装 Chocolatey CLI(Windows)

如前所述,Chocolatey 是 Windows 下的软件管理解决方案,我们将用它来安装 Python 和 Deno。我们需要 Python 来安装和运行 Jupyter Lab IDE,而 Deno 则为 Jupyter Lab 提供 Typescript 语言支持。

如果你使用 Linux,请跳过这些步骤,直接跳到 "在 Linux 上 "安装 Python 和 Deno 部分。

要安装 Chocolatey,请在 "命令提示符"(源文件)中执行以下命令:

@"%SystemRoot%\System32\WindowsPowerShell\v1.0\powershell.exe" -NoProfile -InputFormat None -ExecutionPolicy Bypass -Command "[System.Net.ServicePointManager]::SecurityProtocol = 3072; iex ((New-Object System.Net.WebClient).DownloadString('https://community.chocolatey.org/install.ps1'))" && SET "PATH=%PATH%;%ALLUSERSPROFILE%\chocolatey\bin""%SystemRoot%\System32\WindowsPowerShell\v1.0\powershell.exe" -NoProfile -InputFormat None -ExecutionPolicy Bypass -Command "[System.Net.ServicePointManager]::SecurityProtocol = 3072; iex ((New-Object System.Net.WebClient).DownloadString('https://community.chocolatey.org/install.ps1'))" && SET "PATH=%PATH%;%ALLUSERSPROFILE%\chocolatey\bin"该命令会下载并在计算机上运行远程 install1.ps 脚本,因此在运行前应检查其内容以确保安全。

最重要的Chocolatey CLI命令

- choco list -localonly:列出本地安装的软件包。

- choco install PackageName:安装软件包(你可以在社区软件包仓库中浏览可用的软件包)

- choco upgrade PackageName:升级软件包

- choco uninstall PackageName:卸载软件包

- choco outdated: 列出本地安装的软件包的更新版本

安装 Python 和 Deno

在 Windows 上

在提升命令提示符下,运行 choco install python 安装 Python。然后运行 refreshenv 命令刷新 PATH 和其他环境变量。现在,如果运行 python --version 命令,它将返回 Python 的版本。

运行 python -m pip install -U pip 命令升级 Python 软件包管理器 (pip)。

然后安装 Deno Typescript 内核:

choco install deno

在 Linux 上

在 Linux 上,你可以使用发行版的软件包管理器来安装 Python。然后运行 python -m pip install -U pip 来升级 Python 包管理器 (pip)。

然后安装 Deno Typescript 内核和 Pnpm 软件包管理器:

curl -fsSL https://deno.land/install.sh | sh

在运行这些远程脚本文件之前,应检查其内容以确保安全。

创建 Python 虚拟环境 (venv)

从这一点开始,安装步骤在 Windows 和 Linux 上都非常相似,只是使用 /home/YourUser/ 而不是 C:\Users\YourUser\ 作为你的主目录。

虚拟环境包含一组已安装的软件包。我建议为计算机上每个基于 Python 的项目创建一个单独的虚拟环境,因此我们为 JupyterLab 和 Deno 创建一个新的虚拟环境。你可以稍后再创建其他虚拟环境。

打开命令提示符(非高架),为虚拟环境创建一个新目录:mkdir C:\Users\YourUser\venv,然后使用以下命令创建新的虚拟环境:python -m venv C:\Users\YourUser\venv\jupyter-deno

在使用 C:\Users\YourUser\venv\jupyter-deno\Scripts\activate 命令将软件包安装到虚拟环境之前,我们必须先激活虚拟环境。执行该脚本后,提示符变为 (jupyter-deno) C:\。

最重要的 Python 软件包管理器 (pip) 命令

- pip list:列出本地安装的软件包

- pip install PackageName:安装软件包(可在 Python 软件包索引中浏览可用的软件包)

- pip install --upgrade PackageName:升级软件包

- pip uninstall PackageName:卸载软件包

- pip list --outdated: 列出有更新版本的本地安装的软件包

设置: 使用 Deno 内核安装 JupyterLab

在激活的环境中,我们安装 Jupyter Lab:pip install jupyterlab,然后使用 deno jupyter --unstable --install 命令将 Deno 内核添加到 Jupyter 中。

Jupyter Lab 默认不显示隐藏文件,因此我们在 Jupyter Lab 中看不到 .env 文件。例如,我们使用 .env 文件来存储 OpenAI API 的密钥。要在 Jupyter Lab 的文件管理器中显示这些文件,我们必须使用以下命令生成一个新的 Jupyter 配置文件:

mkdir C:\Users\YourUser\.jupyter

cd C:\Users\YourUser\.jupyter

jupyter server --generate-config

最后一条命令会生成一个 C:\Users\YourUser\.jupyter\jupyter_server_config.py 文件。打开该文件,设置 ContentsManager.allow_hidden = True。重新启动 Jupyter Lab,现在你可以使用 "视图 "菜单中的 "显示隐藏文件 "菜单项在 Jupyter Lab 中显示或隐藏隐藏文件。

作为安装过程的最后一步,为 Jupyter 笔记本创建一个目录,然后启动 Jupyter Lab:

mkdir C:\Users\YourUser\jupyter

cd C:\Users\YourUser\jupyter

jupyter lab

设置: 安装和使用 Ollama

安装 Ollama 和模型

如前所述,我使用 Ollama 运行本地 LLM 模型。

安装 Ollama 后,我建议你下载 codellama:7b-code 模型,它非常适合测试目的:olama pull codellama:7b-code。这是一个小型模型,大约需要 4 GB 内存。我在只有 16GB 内存和双核 CPU 的旧笔记本电脑上使用这个模型,它给出的响应速度可以接受。我在 "文本审阅器应用程序 "的原型中也使用了这个本地模型。

最重要的 Ollama 命令:

- ollama list 列出下载的模型

- ollama pull ModelName:version 下载一个 LLM 模型

- ollama serve 在后台运行 Ollama 服务器

用本地模型试试我们的第一个人工智能原型

如果还没有启动 Jupyter Lab,请激活虚拟环境,并使用 jupyter lab 命令在虚拟环境中启动 Jupyter Lab。你可以在浏览器中打开用户界面:http://localhost:8888/。使用 ollama serve 启动 Ollama。

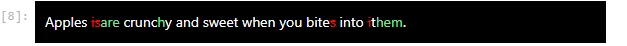

将包含应用程序原型的笔记本下载到 C:\Users\YourUser\jupyter 目录中。从 JupyterLab 的文件浏览器(屏幕左侧面板)中选择下载的笔记本,然后从 "编辑 "菜单中选择 "清除所有单元格的输出"(Clear Outputs of All Cells),删除单元格中所有保存的输出,然后点击 "运行 "菜单中的 "运行所有单元格"(Run all cells)菜单项。经过一些处理后,最后一个单元格上方应该可以看到比较结果: