谷歌刚刚构建了零样本时间序列预测的基础模型

时间序列预测是机器学习(ML)早期的经典应用场景之一。对时间序列数据进行预测的能力与零售、金融、制造、医疗保健、自然科学以及股市预测等许多领域息息相关。尽管具有相关性,但与我们所看到的 LLM、计算机视觉和其他生成式人工智能领域的快速发展相比,这些领域的进展就显得微不足道了。预训练模型的模式是否适用于时间序列预测场景?谷歌最近发表了一篇研究论文,概述了一种仅用于解码器的时间序列预测预训练模型,似乎相信这一点。谷歌还宣布,在不久的将来,Vertex AI 将提供这种新模型。

与此同时,LLM 领域也在快速发展,尤其是大型基础模型的开发。这些模型在生成文本、翻译语言、创建多种形式的内容以及详细回答查询等方面具有多功能性,因而备受关注。通过在大量数据集上的训练,这些模型能够掌握人类语言的细微差别,从而在一系列任务中发挥巨大作用,而且通常不需要额外的、针对特定任务的训练。

这一进展提出了一个问题:在大量时间序列数据基础上训练出来的大型模型,能否很好地识别和学习时间模式,以预测它以前从未见过的数据中的未来事件?具体来说,我们的想法是创建一个基础时间序列模型,该模型能够为新数据集提供开箱即用的准确预测,从而大幅减少预测任务对大量训练数据和计算资源的需求。

然而,创建这样一个模型面临着独特的挑战。与语言不同,时间序列数据没有固定的词汇或语法,模型需要适应不同长度的历史数据、预测期和数据频率。此外,与可用于训练语言模型的大量文本数据不同,类似的庞大时间序列数据存储库并不容易获取。

尽管存在这些障碍,谷歌提供的证据表明,开发基础时间序列预测模型确实是可行的,这也预示着未来准确的预测在广泛的应用中将变得更加容易和高效。

架构

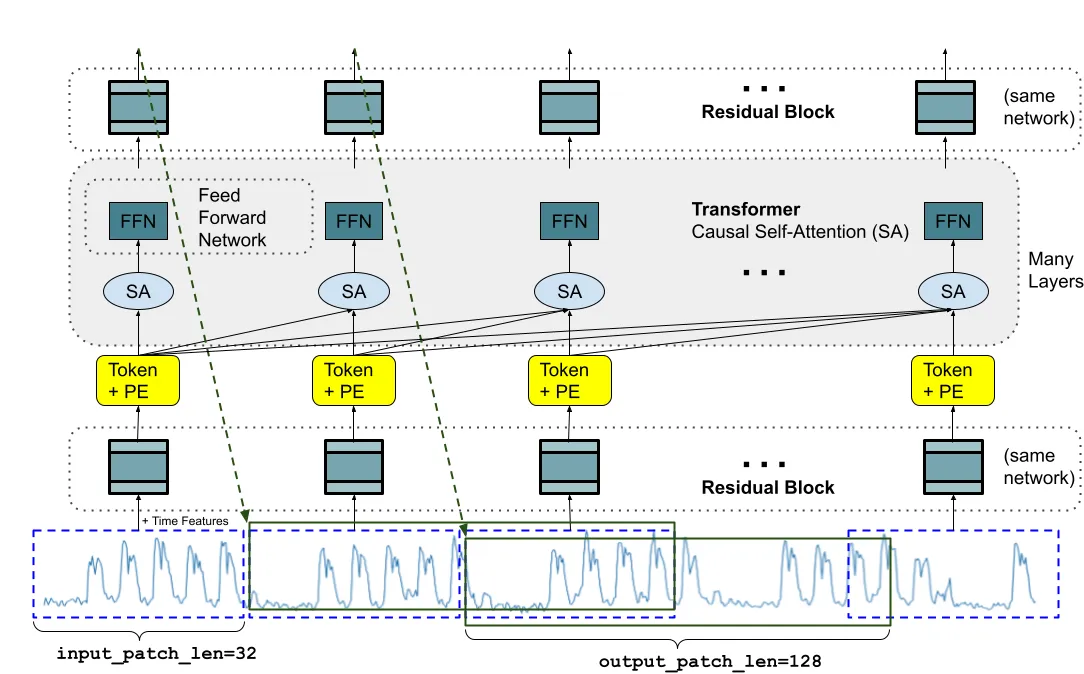

谷歌用于时间序列预测的基础模型是一个纯解码器模型。架构选择遵循一系列关键原则。

1. 修补:修补的概念基于在训练过程中将时间序列数据分割成修补区,类似于语言模型中的词块功能。这种策略不仅能提高模型性能,还能通过减少转换器需要处理的数据量来加快推理速度。尽管如此,谷歌仍然保持着谨慎的平衡,以避免过分偏离以高效著称的纯解码器训练方法。

2. 仅解码器模型:与一些同时使用编码器和解码器机制的现有模型不同,谷歌的模型仅在解码器模式下运行。这意味着它仅根据过去的数据片段序列来预测未来的数据片段,这种方法允许对整个上下文窗口进行并行处理。这种方法反映了大型语言模型(LLM)的自动回归特性,但特别适用于预测未来的长期事件。

3. 更长的输出斑块: 谷歌还提出了一个新颖的解决方案,以提高长视距预测的准确性。通过允许预测的输出片段比输入片段更长,模型可以利用更广泛的背景进行预测,从而提高预测能力。这种方法与传统的分步预测法形成鲜明对比,为预测未来时间点提供了一种更高效、更准确的方法。

4. 斑块屏蔽: 在训练过程中引入斑块屏蔽,确保模型能够处理任何大小的背景长度,而不仅仅是输入斑块长度的倍数。这一策略包括随机屏蔽部分或整个补丁,使模型能够从不同的上下文长度中学习。

谷歌模型的架构骨架与 LLM 的结构非常相似,利用堆叠转换层通过自注意层和前馈层处理输入补丁(作为标记)。该模型的一个独特之处在于,它使用具有残差连接的多层感知器块将时间序列补丁转换为标记,这种技术已在之前的长距预测工作中被证明是有效的。此外,该模型旨在预测比输入时间点更长的未来时间点序列,从而实现更全面的预测能力。

谷歌的这一方法标志着时间序列预测领域的重大进步,它利用基于变压器的架构来适应基于过去数据预测未来事件的独特挑战,展示了针对时间序列数据的复杂性而量身定制的创新性和实用性的融合。

成果

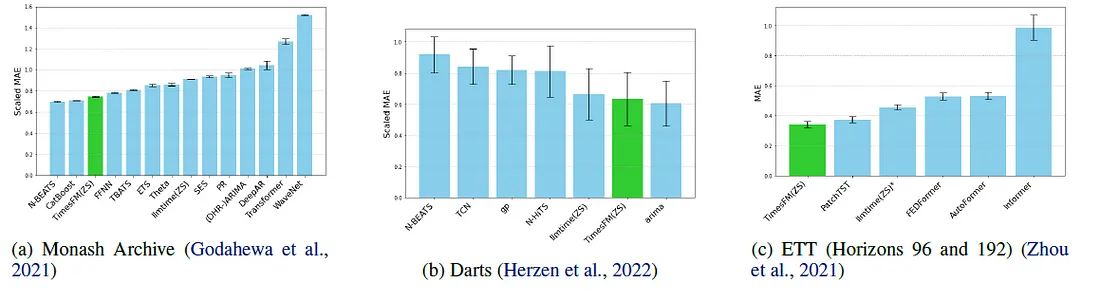

谷歌对其时间序列预测模型进行了广泛的评估,事先并未接触特定的数据集,而是选择了三个关键数据集进行评估:

第一个数据集被称为莫纳什档案,包含 30 个数据集,这些数据集的训练和预测长度各不相同。这些数据集的粒度范围很广,从几分钟到几年不等,涵盖了金融、需求预测、天气和交通等多个领域,为模型的多功能性提供了一个全面的测试平台。

接下来,他们研究了由 8 个单变量数据集组成的 Darts 数据集。这些数据集具有明显的季节性模式和趋势,既有加法也有乘法,对模型捕捉和预测重复模式的能力提出了集中挑战。

最后,Informer 数据集也被纳入了评估范围,该数据集因用于测试有监督的长期预测方法而广受好评。不过,Google 将注意力集中在这些数据集的一个子集上,而这些数据集并非模型预训练阶段的一部分。具体来说,他们关注的是两年内以一小时和十五分钟为间隔记录的电力变压器温度数据集,即 ETTm1、ETTm2、ETTh1 和 ETTh2。

这些数据集的选择为谷歌提供了广泛而具有挑战性的数据,确保对模型在各种时间序列情况下的预测能力进行严格测试。

谷歌正在利用其预训练解码器模型挑战时间序列预测的极限。这似乎是一个大胆的想法,但希望它能激发该领域更多的研究。