英伟达与Snowflake合作开发大型语言模型AI

2023年06月28日 由 daydream 发表

492638

0

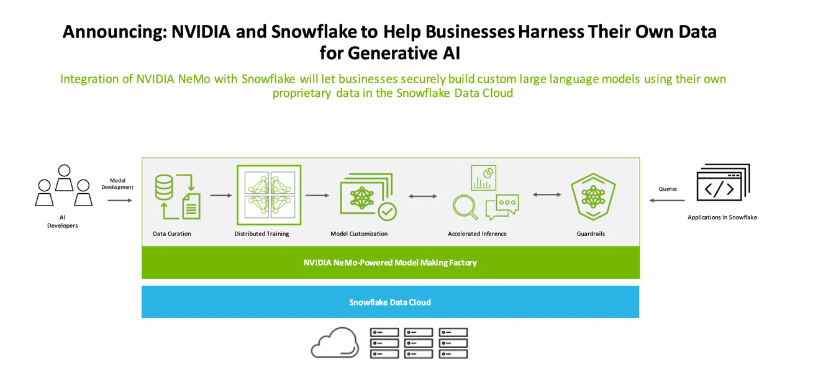

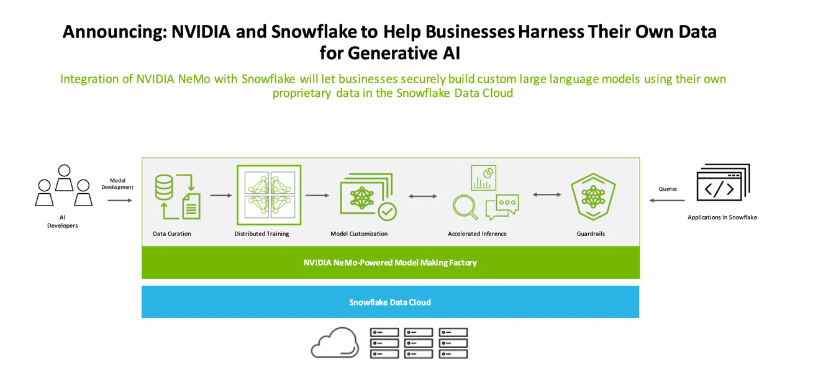

在Snowflake 2023用户大会上,云数据库制造商Snowflake宣布与芯片巨头Nvidia达成合作伙伴关系,共同处理所谓的AI基础模型。

根据该安排,Snowflake的客户将能够租用Snowflake的数据仓库安装的云GPU容量,并利用该容量使用Nvidia去年推出的NeMo框架优化神经网络。基础模型是非常大的神经网络,例如大型语言模型,通常会“预训练”,也就是说,它们已经达到了一定的能力水平。

客户将使用Snowflake的数据仓库,利用自己的数据开发定制版本的NeMo基础模型,以满足其需求。

Nvidia的企业计算副总裁Manuvir Das在一次新闻简报中表示:“这对于两家公司来说是一种非常自然的结合。”Das继续说道:

"Nvidia和Snowflake联手合作的原因是,如果企业需要根据其数据创建用于生成式AI的定制模型,而这些数据存储在Snowflake的数据云中,那么为什么不将Nvidia的模型构建引擎(即NeMo)引入Snowflake的数据云中,使企业客户能够直接在其数据云上生成这些模型,然后应用于其业务用例。"

这一宣布是利用人工智能特别是生成式人工智能作为商业工具的日益增长趋势的一部分。周一,Apache Spark开发者Databricks以13亿美元的价格收购了初创公司MosaicML,该公司提供训练和部署基础模型的服务,这令科技行业大为震惊。

Snowflake将通过从其已有合作伙伴那里采购Nvidia GPU实例来实施该服务。Das表示:“现在,我们只是在讨论拓展该合作关系,将GPU实例纳入其中。”

周二,Snowflake在另一份消息中宣布将其Snowpark开发平台扩展到目前处于私有预览阶段的Snowpark容器服务。该公司在消息中表示:“通过扩展Snowpark的范围,开发人员可以解锁更广泛的基础设施选项,如使用Nvidia GPU进行加速计算和AI软件,从而在Snowflake的安全和治理平台内无需复杂操作地运行更多工作负载,包括更广泛的人工智能和机器学习(ML)模型、API、内部开发的应用程序等。”

Das说道:“Snowflake有一个设计结构,确保当客户选择在Snowflake数据云上进行计算时,它仍然保持在该客户的边界内,然后NeMo引擎只是适应这个模型。”

Das补充道:“当然,NeMo也有安全责任,这就是为什么这是一项共同的工程工作。”

此次合作是继Nvidia与ServiceNow达成合作伙伴关系近期宣布使用NeMo与ServiceNow的IT服务客户之后的最新动态。Das表示,Snowflake的合作是“通用型”的合作,而ServiceNow的合作则“更像是ISV(独立软件供应商)模式”。ServiceNow使用NeMo代码为每个客户训练定制模型,“这样,当他们的每个客户进行IT工作并打开[故障]工单时,他们将得到特定于该客户的响应”。

Nvidia首席执行官黄仁勋将软件定位为公司的重要增长引擎,该公司靠销售GPU硬件用于开发神经网络而获得数十亿美元的收入。NeMo是该公司推广的企业软件堆栈的一部分,其中很大一部分是通过与云服务提供商的合作实现的。

今年三月,英伟达首席财务官科莱特·克雷斯(Colette Kress)在摩根士丹利(Morgan Stanley)的一次会议上告诉投资者,“我们现在的软件业务收入达数亿美元,我们认为这仍然是我们前进的增长机会。

来源:https://www.zdnet.com/article/nvidia-teams-up-with-snowflake-for-large-language-model-ai/

根据该安排,Snowflake的客户将能够租用Snowflake的数据仓库安装的云GPU容量,并利用该容量使用Nvidia去年推出的NeMo框架优化神经网络。基础模型是非常大的神经网络,例如大型语言模型,通常会“预训练”,也就是说,它们已经达到了一定的能力水平。

客户将使用Snowflake的数据仓库,利用自己的数据开发定制版本的NeMo基础模型,以满足其需求。

Nvidia的企业计算副总裁Manuvir Das在一次新闻简报中表示:“这对于两家公司来说是一种非常自然的结合。”Das继续说道:

"Nvidia和Snowflake联手合作的原因是,如果企业需要根据其数据创建用于生成式AI的定制模型,而这些数据存储在Snowflake的数据云中,那么为什么不将Nvidia的模型构建引擎(即NeMo)引入Snowflake的数据云中,使企业客户能够直接在其数据云上生成这些模型,然后应用于其业务用例。"

这一宣布是利用人工智能特别是生成式人工智能作为商业工具的日益增长趋势的一部分。周一,Apache Spark开发者Databricks以13亿美元的价格收购了初创公司MosaicML,该公司提供训练和部署基础模型的服务,这令科技行业大为震惊。

Snowflake将通过从其已有合作伙伴那里采购Nvidia GPU实例来实施该服务。Das表示:“现在,我们只是在讨论拓展该合作关系,将GPU实例纳入其中。”

周二,Snowflake在另一份消息中宣布将其Snowpark开发平台扩展到目前处于私有预览阶段的Snowpark容器服务。该公司在消息中表示:“通过扩展Snowpark的范围,开发人员可以解锁更广泛的基础设施选项,如使用Nvidia GPU进行加速计算和AI软件,从而在Snowflake的安全和治理平台内无需复杂操作地运行更多工作负载,包括更广泛的人工智能和机器学习(ML)模型、API、内部开发的应用程序等。”

Das说道:“Snowflake有一个设计结构,确保当客户选择在Snowflake数据云上进行计算时,它仍然保持在该客户的边界内,然后NeMo引擎只是适应这个模型。”

Das补充道:“当然,NeMo也有安全责任,这就是为什么这是一项共同的工程工作。”

此次合作是继Nvidia与ServiceNow达成合作伙伴关系近期宣布使用NeMo与ServiceNow的IT服务客户之后的最新动态。Das表示,Snowflake的合作是“通用型”的合作,而ServiceNow的合作则“更像是ISV(独立软件供应商)模式”。ServiceNow使用NeMo代码为每个客户训练定制模型,“这样,当他们的每个客户进行IT工作并打开[故障]工单时,他们将得到特定于该客户的响应”。

Nvidia首席执行官黄仁勋将软件定位为公司的重要增长引擎,该公司靠销售GPU硬件用于开发神经网络而获得数十亿美元的收入。NeMo是该公司推广的企业软件堆栈的一部分,其中很大一部分是通过与云服务提供商的合作实现的。

今年三月,英伟达首席财务官科莱特·克雷斯(Colette Kress)在摩根士丹利(Morgan Stanley)的一次会议上告诉投资者,“我们现在的软件业务收入达数亿美元,我们认为这仍然是我们前进的增长机会。

来源:https://www.zdnet.com/article/nvidia-teams-up-with-snowflake-for-large-language-model-ai/

欢迎关注ATYUN官方公众号

商务合作及内容投稿请联系邮箱:bd@atyun.com

热门企业

热门职位

写评论取消

回复取消