MIT和微软开发新模型,识别盲点,提高AI系统安全性

2019年01月29日 由 浅浅 发表

520905

0

MIT和微软研究人员开发了一种新模型,识别自主系统从训练样本中学习的与现实状况不符的实例。该模型可用来提高AI系统的安全性,例如自动驾驶车辆和机器人。

MIT和微软研究人员开发了一种新模型,识别自主系统从训练样本中学习的与现实状况不符的实例。该模型可用来提高AI系统的安全性,例如自动驾驶车辆和机器人。例如,为自动驾驶汽车提供动力的AI系统在虚拟模拟中得到了广泛的训练,以便让车辆为路上几乎所有的事件做好准备。但有时汽车会在现实世界中犯一个意想不到的错误。

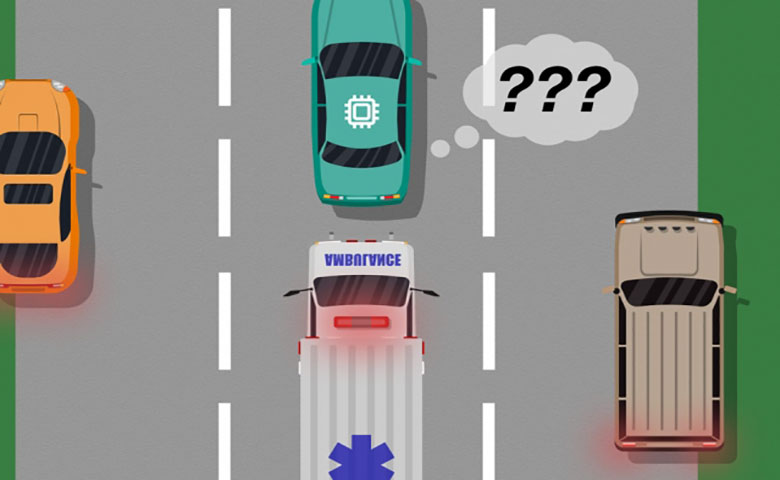

比如一辆未经过训练的自动驾驶汽车,重要的是它没有必要的传感器以区分截然不同的场景:白色大型汽车和道路上闪着红灯的救护车。如果一辆车在高速公路上行驶,一辆救护车鸣笛,这辆车可能不知道要减速并靠边停车,因为它并不认为这辆救护车与一辆白色的大车有什么不同。

在论文中,研究人员描述了一个利用人类输入来揭示这些训练盲点的模型。

与传统方法一样,研究人员通过模拟训练设置了AI系统。但是,当人们在现实世界中行动时,人类密切监视系统的行为,在系统制造或即将发生任何错误时提供反馈。然后,研究人员将训练数据与人体反馈数据相结合,并使用机器学习技术生成一个模型,该模型可以精确确定系统最有可能需要更多如何正确操作的信息。

研究人员使用视频游戏验证了该方法,模拟人员校正了屏幕角色的学习路径。但下一步是将该模型与传统的自动驾驶汽车和机器人训练和测试方法相结合,并提供人工反馈。

论文第一作者,CSAIL的研究生Ramya Ramakrishnan表示,“这个模型帮助自主系统更好地了解它们不知道的东西,很多时候,当部署这些系统时,它们训练过的模拟与现实环境不匹配使它们可能会犯错误,甚至发生事故。我们的想法是用人类以安全的方式,缩小模拟与真实世界的差距,减少其中的一些错误。”

接受反馈

一些传统的训练方法确实在实际测试运行期间提供人工反馈,但仅用于更新系统的操作。这些方法不能识别盲点。

研究人员首先通过模拟训练建立一个AI系统,在那里它将产生一个“策略”,将每种情况映射到它在模拟中能够采取的最佳行动。然后,系统将被部署在现实世界中,其中,人们在系统行为不可接受的区域提供错误信号。

人类可以通过多种方式提供数据,例如“示范”和“修正”。在示范中,人类在现实世界中行动,而系统则观察并比较人类的行为与它在那种情况下所做的事情。例如,对于自动驾驶汽车,如果计划行为偏离人类行为,则人类会手动控制汽车,而系统会发出信号。与人类行为的匹配与否提供了噪声指示,系统行为可能是可接受的,也可能是不可接受的。

另外,人类可以通过监视系统在现实世界中的行为进行修正。当自动驾驶汽车沿着其计划的路线行驶时,人可以坐在驾驶座上。如果汽车的行为是正确的,人类什么都不做。然而,如果汽车的动作是不正确的,那么人可能会接管并发出一个信号,表明系统在该特定情况下采取了不可接受的行为。

一旦编译了来自人的反馈数据,系统基本上掌握了情况列表,并且对于每种情况,多个标签说明其行为是可接受的或不可接受的。单一情况可以接收许多不同的信号,因为系统将许多情况视为相同的。

例如,自动驾驶汽车可能会在大型汽车旁边多次巡航而不会减速或停下。但是,在一个例子中,与系统看起来完全相同一辆救护车经过,自动驾驶汽车没有停车就会接收反馈信号,表示系统采取了不可接受的行动。

“在这一点上,系统已经被人类发出了多个相互矛盾的信号:一些人旁边有一辆大型汽车,而且一切都很好,还有一辆救护车在同一个位置,但那不是很好。系统稍微注意到它做错了什么,但它不知道为什么,“Ramakrishnan说。“因为代理人正在获得所有这些矛盾的信号,下一步是编制信息,问我'在我收到这些混合信号的情况下,我有多大可能犯错?'”

Ramakrishnan表示,“该系统收到了来自一名人类的多个相互矛盾的信号,系统会记录下它做错了,但是它不知道为什么。当智能体得到了所有这些矛盾的信号,下一步就是整理信息并提问,在接收到这些混合信号的情况下,犯错误的可能性有多大?”

智能聚合

最终目标是将这些模棱两可的情况标记为盲点。但这不仅仅是为每种情况简单地计算可接受和不可接受的行动。例如,如果系统在救护车情况下10次中有9次执行了正确动作,那么简单的多数投票机制就会将这种情况标记为安全。

“但由于不可接受的行为远比可接受的行动少得多,该系统最终会学会将所有情况标记为安全,这可能非常危险,”Ramakrishnan说。

为此,研究人员使用了Dawid-Skene算法,这是一种通常用于众包处理标记噪声的机器学习方法。该算法将一系列情况作为输入,每个情况都有一组带噪声的“可接受”和“不可接受”的标记。

然后,它聚合所有数据,并使用一些概率计算来识别预测盲点标记中的模式和预测安全情况的模式。使用该信息,它为每种情况输出单个聚合的“安全”或“盲点”标记以及该标记中的置信水平。

最后,该算法生成一种“热图”,其中来自系统原始训练的每种情况作为系统的盲点,按从低到高的概率指定。

Ramakrishnan表示,“当系统部署到现实世界中时,它可以使用这种学习模型更谨慎,更智能地行动。如果学习模型预测状态是一个具有高概率的盲点,系统可以向人类查询可接受的动作,从而实行更安全的行动。”

这项研究很好地发现了模拟和现实世界之间何时存在不匹配的情况,具有很大的潜力,可以让机器人预测自己在新情况下可能会在什么时候采取错误的行动,而不是人类操作员。接下来的挑战将是利用这些发现的盲点来改善机器人的内部表现,以更好地与现实世界匹配。

欢迎关注ATYUN官方公众号

商务合作及内容投稿请联系邮箱:bd@atyun.com

热门企业

热门职位

写评论取消

回复取消