Judea Pearl:要建立真正的智能机器,教它们因果关系才是关键

2018年05月16日 由 浅浅 发表

931177

0

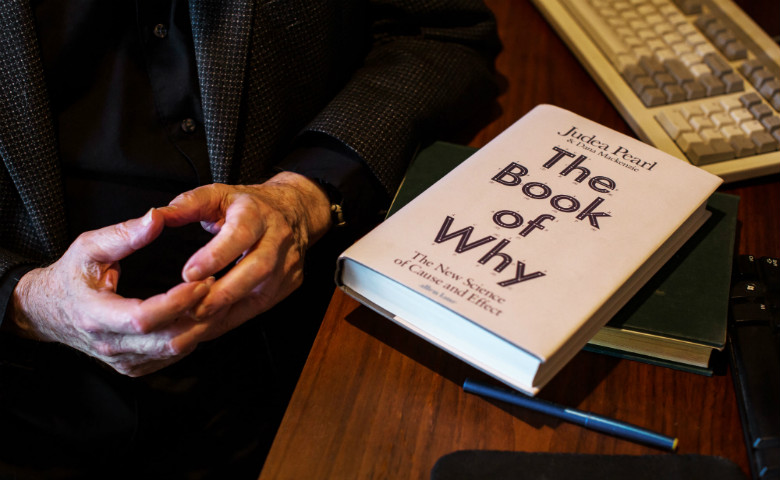

人工智能给Judea Pearl(贝叶斯之父)带来诸多启发。在二十世纪八十年代,他领导的工作使机器能够以概率方式进行推理。现在他是该领域最敏锐的评论家之一。在他的最新著作“The Book of Why: The New Science of Cause and Effect”中,他认为人工智能的发展由于对智能真正含义不完全理解而受到阻碍。

三十年前,人工智能研究面临的主要挑战是编制机器将潜在原因与一系列可观察条件联系起来。Pearl利用一种称为贝叶斯网络的方案想出了如何做到这一点。贝叶斯网络使得机器更有实用性,比如认为从非洲回来后发热且身体酸痛的患者,最可能的病因是疟疾。在2011年,Pearl主要因这项工作赢得了图灵奖,这是计算机科学的最高荣誉。

但是,正如Pearl所看到的那样,人工智能领域陷入了概率关联的困境。最近头条新闻报道了机器学习和神经网络的最新突破。我们阅读有关计算机可以掌握古代游戏和驾驶汽车的新闻。Pearl不以为然,正如他所看到的那样,今天人工智能领域的技术水平只不过是上一代机器已有功能的增强版:在大量数据中发现隐藏的规律性。“所有令人印象深刻的深度学习成果都只是曲线拟合,”他最近这样说道。

在新书中,现年81岁的Pearl详细阐述了智能机器如何真正思考的愿景。他认为,关键在于用结合因果推理来取代推理。机器不仅仅有将发热和疟疾关联起来的能力,而是需要能够推断疟疾引起发烧的能力。一旦这种因果关系框架到位,机器就有可能提出反事实问题,以此查询因给予某种干预而引起的因果关系如何改变,Pearl将其视为科学思想的基石。Pearl还提出了一种形式化的语言,使这种思维成为可能:21世纪的贝叶斯框架版本允许机器以概率形式思考。

Pearl期望因果推理可以为机器提供人类水平的智能。他解释说,他们可以更有效地与人类沟通,甚至可以实现具有自由意志或邪恶思维的道德实体的地位。Quanta Magazine在最近的一次圣地亚哥会议上与Pearl进行谈话,随后通过电话与他进行了后续采访。对话的如下。

Q:为什么你的新书名是“The Book of Why”?

A:它是对过去25年来我一直在做的工作的总结,包括因果关系、在一个人生活中的含义、应用以及我们如何提出对固有因果问题的答案。奇怪的是,这些问题已经被科学抛弃了。所以我在这里补上了这一点。

Q:科学已经放弃了因果关系,这很戏剧化。可这不正是科学的全部内容吗?

A:当然了,但是在科学方程式中你看不到这种期望。代数的语言是对称的:如果X告诉我们有关Y的信息,那么Y就会告诉我们关于X的信息。我指的是确定性关系。在数学中无法写出一个简单的事实,例如,即将到来的暴风雨会导致晴雨表下降,而不是相反。数学并没有非对称性语言可以捕捉我们的理解,比如,X导致Y并不意味着Y会导致X。我知道,这对于科学来说是一件可怕的事情。

但是科学更为宽容:鉴于我们缺少不对称关系的微积分,科学鼓励我们创造一种关系。从这里就要引入数学了。对我而言,看到简单的因果演算解决了我们这个时代最伟大的统计学家被认为是不明确或无法解决的问题,这结果令人兴奋不已。

Q:几十年前,你通过教授机器如何进行概率推理而名声大噪,能说明一下当时AI的发展情况吗?

A:20世纪80年代初出现的问题具有预测性或可诊断性。医生会从患者身上看到一系列症状,并提出患者患有疟疾或其他疾病的可能性。我们希望自动系统和专家系统能够替代专业人员,无论是医生还是矿物探险家,还是其他类型的付费专家。所以在那时我提出了概率性这个想法。

不幸的是,标准概率计算需要指数空间和指数时间。我想出了一个称为贝叶斯网络的方案,它需要多项式时间,并且也非常透明。

Q:但是在你的新书中,你认为自己与今天的AI背道而驰,理由是什么?

A:就我们开发的工具而言,只要我们的机器能够以不确定的方式推理,我就会去追求更具挑战性的任务:因果推理。我许多做AI的同事对此仍然不确定,有些研究圈子继续在诊断方面工作,而不去担心问题的因果关系。他们想要的只是预测好,诊断良好。

举个例子来说,我们今天看到的所有机器学习工作都是在诊断模式下进行的,比如说将对象标记为“猫”或“老虎”。他们不关心干预,他们只是想识别一个对象并预测它在一段时间内将如何发展。

当我开发出用于预测和诊断的强大工具时,这虽然只是人类智能的冰山一角,但我有一种背离感。如果我们想要机器推理干预措施(“如果我们禁止香烟怎么办?”)和内省(“如果我读完了高中要做什么?”),我们必须引用因果模型。光靠关联是远远是不够的,这是一个数学事实,而非主观意见。

Q:人们对AI的可能性感到兴奋,你不觉得吗?

A:就像我深入了解深度学习的过程一样,我发现他们都在联系的层面上坚持下去,即曲线拟合。这听起来像是一种亵渎,说深度学习的所有令人印象深刻的成就只是为数据拟合一条曲线。从数学的角度来看,不管操作数据的方式多么巧妙,在操作数据时读入的数据如何,它仍然是一个曲线拟合练习,虽然复杂却非常平庸。

Q:您谈论曲线拟合的方式,听起来好像对机器学习并不是很感兴趣。

A:不,这给我留下了深刻的印象,因为我们没有想到可以通过纯曲线拟合来解决这么多问题。事实证明,他们可以。但我想问,接下来呢?能否有一位机器人科学家来计划一个实验,并找到未决科学问题的新答案?这是下一步。我们也希望与一台有意义的机器进行一些沟通,这种有意义的方式意味着符合我们的直觉。如果你剥夺机器人关于原因和结果的直觉,你永远不会与它进行有意义的交流。机器人无法像你我那样说“我本该做得更好”。我们因此失去了一个重要的沟通渠道。

Q:有什么机会分享我们对因果关系的直觉?

A:我们必须为机器配备环境模型。如果一台机器没有现实的模型,那么你不能指望机器在现实中表现得很聪明。第一步,在10年内迈出一步,现实的概念模型将由人类编程。

下一步将是机器自行假设这些模型,并根据经验证据对它们进行验证和改进。这就是科学,我们从一个以地心为中心的模型开始,到圆和循环,最后以椭圆形的日心模型结束。

机器人也将相互沟通,并用隐喻的模型内化这个假想的世界。

Q:当你今天与AI工作的人分享这些想法时,他们是如何反应的?

A:人们对AI看法不一。首先,有机器学习、深度学习和神经网络的成功令人陶醉。他们不明白我的想法。他们希望继续拟合曲线。但是当你与在统计学习以外从事人工智能工作的人谈话时,他们会立即理解我的意思。

Q:你是否认为目前有非机器学习的发展趋势?

A:这不是一种趋势,而是一种认真的探索,我们会问:我们要去哪里?下一步是什么?

Q:这也是我想问你的最后的问题。

A:我很高兴你没有问我关于自由意志的事情。

Q:在那种情况下,你如何看待自由意志?

A:绝对会有机器人拥有自由意志。我们必须了解如何对它们进行编程,以及我们从中会获得什么。出于某种原因,进化逻辑中这种自由意志的感觉是可以计算的。

Q:以什么方式呢?

A:你有自由意志的感觉,进化为我们带来了这种感觉。显然,它有一定的计算功能。

Q:怎么看出机器人拥有自由意志?

A:我想第一个证据是机器人开始进行反事实交流,比如它说“你本该做得更好”。如果一个踢足球的机器人开始用这种语言沟通,那么我们就会知道他们有一种感觉,那就是自由意志。“你本该把球传给我的,我一直等着你,但你没有传球!”所以自由意志的第一个标志就是沟通。

欢迎关注ATYUN官方公众号

商务合作及内容投稿请联系邮箱:bd@atyun.com

热门企业

热门职位

写评论取消

回复取消