苹果和IBM将通过新的机器学习集成展开合作

2018年03月21日 由 nanan 发表

650128

0

周一晚些时候,苹果和IBM宣布扩大现有合作伙伴关系,允许客户通过苹果的Core ML和IBM的Watson(沃森)技术推出先进的应用内机器学习能力。

正如TechCrunch所详述的那样,该项目的扩展允许客户开发基于Watson(沃森)技术的机器学习工具,然后将这些资产应用于苹果移动设备上的应用程序。

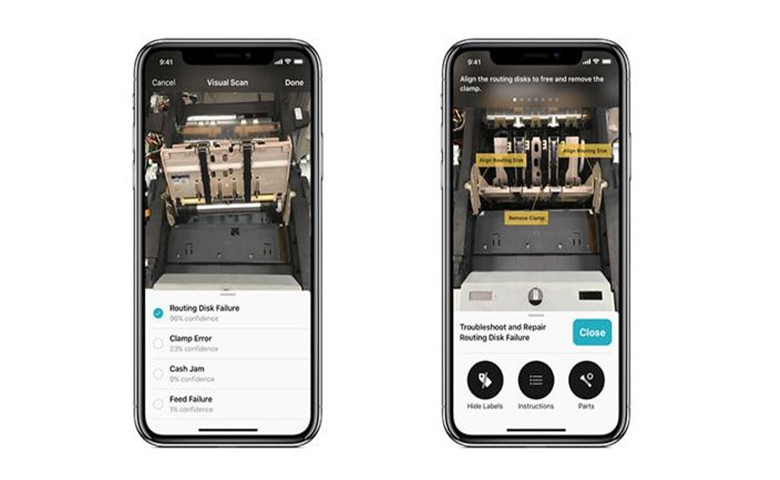

据苹果公司称,该项目名为“Watson Services for Core ML”,其允许员工使用配备的MobileFirst应用程序来分析图像,对视觉内容进行分类,并使用Watson服务来训练模型。Watson的视觉识别提供了预先训练的机器学习模型,支持图像分析,以识别场景、物体、面孔、颜色、食物和其他内容。重要的是,图像分类器可以根据客户需求进行定制。

例如,一个集成到iOS企业应用程序的机器学习模型,可以通过使用Watson的图像识别能力来识别照片或实时iPhone相机视图中的损坏设备。在确定品牌和型号后,技术人员可以要求应用程序运行数据库查询来修复部件,返回诊断程序,识别屏幕上的部件,甚至评估潜在的问题。

将Watson技术集成到iOS中是一个相当简单的工作流程。客户首先使用Watson构建机器学习模型,Watson可以访问非现场数据存储库 。该模型被转换为Core ML,在一个定制应用程序中实现,然后通过IBM的MobileFirst平台进行分发。

去年在全球开发者大会上推出的Core ML平台工具,可以将训练使用的第三方工具所构建的神经网络模型集成到iOS应用程序中。该框架是苹果进军机器学习的一部分,该机器学习开始于iOS 11和A11仿生芯片。

IBM的总经理Mahmoud Naghshineh表示,苹果开发人员需要一种快速、轻松构建这些应用程序的方法,并利用它所提供的云。

在这一点上,IBM还推出了针对苹果的IBM Cloud Developer Console,这是一款基于云的服务,可简化Watson模型构建到应用程序中的过程。这种安排允许应用程序与其主要数据库之间的数据共享,这意味着如果客户如此选择,底层的机器学习模型可以随着时间的推移自行改进。用户还可以利用IBM云服务,涵盖身份验证、数据、分析等。

Naghshineh TechCrunch说:“这就是这种组合的美妙之处,当你运行这个应用程序时,它是实时的,你不需要连接到Watson;但是当你在设备上对不同部分进行分类时,这些数据会被收集起来;当你通过较低的交互基础连接到Watson时,你可以将其反馈到训练机器学习模型,并使其变得更好。”

苹果和IBM在2014年首度合作开展了MobileFirst企业计划。根据协议,IBM处理硬件租赁、设备管理、安全、分析、移动集成和现场维修,而苹果则通过AppleCare来帮助软件开发和客户支持。

2016年,IBM将Watson技术加入到此项计划中,允许客户可以访问自然语言处理和Watson对话等内部API。今天的机器学习能力是这些努力的延伸。

许多公司现在都依赖于MobileFirst应用程序来进行业务操作,从航空旅行到医疗保健再到电信。去年,西班牙Santander银行通过一系列旨在向金融专家提供相关数据的应用程序,将解决方案带入了银行领域。最近,IBM在上海和布加勒斯特扩展了其“车库”概念,即专门用于MobileFirst开发的实体办公空间,并增加了新设施。

欢迎关注ATYUN官方公众号

商务合作及内容投稿请联系邮箱:bd@atyun.com

热门企业

热门职位

写评论取消

回复取消