英特尔的Movidius AI加速技术适用于mini-PCIe版本,旨在加速神经网络

2018年03月07日 由 nanan 发表

322711

0

Aaeon公司推出了“UP AI Core”—— mini-PCIe版本的英特尔Movidius神经计算棒,用于神经网络加速,可用于UP Squared SBC和其他Ubuntu驱动的x86_64计算机,预计4月上市,售价为69美元。

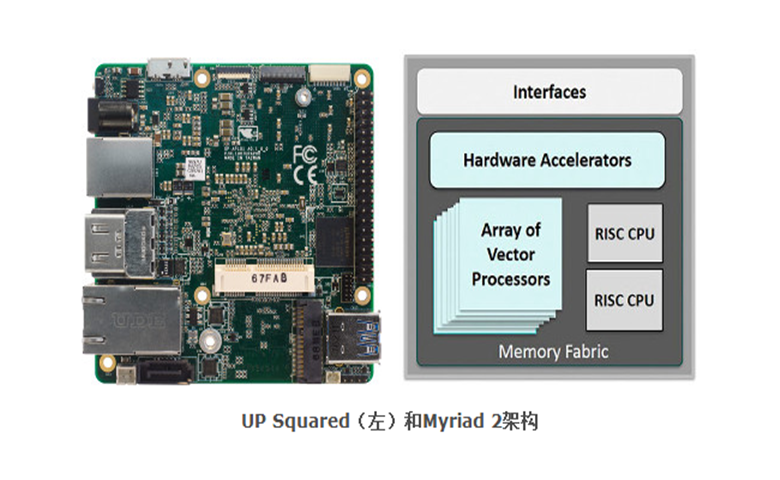

正如英特尔在上周宣布“Intel AI”时所承诺的那样:在其Movidius神经计算棒的生产程序中,Aaeon推出了一款名为UP AI Core的mini-PCIe版本。它同样集成了英特尔注入AI的Myriad 2视觉处理单元(VPU)。与连接到基于云的服务相比,mini-PCIe连接应该为神经网络和机器视觉提供更快的响应时间。

Aaeon表示,该模块的设计是为了“通过硬件加速深度学习和增强的机器视觉功能来增强工业物联网边缘设备。”它还可以实现“无人机、高端虚拟现实头盔、机器人、智能家居设备、智能相机和视频监控解决方案等产品中的目标识别”。

UP AI Core针对Aaeon的ubuntuc支持的UP Squared hacker board进行了优化,其可在英特尔的Apollo Lake SoC上运行。然而,它应该可以与配备运行Ubuntu 16.04的mini-PCIe插槽的任何64位x86计算机或SBC配合使用。主机系统也需要1GB RAM和4GB的空闲存储空间。这为个人电脑和嵌入式电脑提供了大量的选择,尽管目前的UP Squared是唯一一个基于x86的社区支持SBC,配备了一个mini-PCIe插槽。

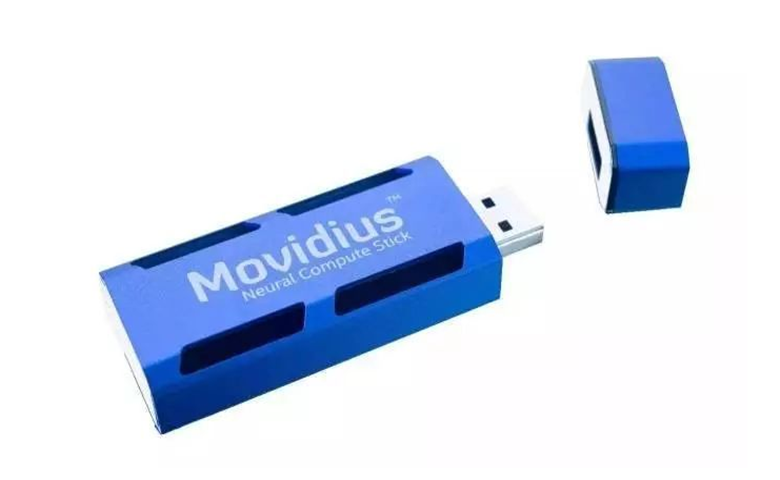

Aaeon几乎没有关于该模块的技术细节,只是说它拥有512MB的DDR RAM,并提供超低功耗。与英特尔的79美元的Movidius神经计算棒所使用的USB连接相比,UP AI Core的mini-PCIe接口可能提供更快的响应时间。然而,Aaeon并没有宣称这一效应,或许是为了避免贬低英特尔的神经计算棒,或其他基于英特尔®AI:In Production计划的USB产品。

两种产品之间的性能差异也可以忽略不计,特别是与本地处理解决方案和Internet连接之间的差异相比。Aaeon表示,基于云的连接用于访问神经网络服务,会降低延迟、网络带宽、可靠性和安全性的影响。该公司建议使用基于linux的SDK“在云中创建和训练您的神经网络,然后在AI Core上本地运行”。

不考虑性能问题,因为mini-PCIe模块通常嵌入在计算机中,所以它比USB stck提供更高的安全性。另一方面,同样的特质阻碍了移动的便利性。与UP AI Core不同,Neural Compute Stick可以在基于ARM的Raspberry Pi上运行,但只能在Stretch桌面或Ubuntu 16.04 VirtualBox实例的帮助下运行。

2016年,在被英特尔收购之前,Movidius公司推出了第一款Myriad 2 VPU技术的本地处理版本,名为Fathom。这款由Ubuntu驱动的USB记忆棒,在早期的Myriad 2参考板中实现了技术的小型化,与英特尔的Movidius神经计算棒重新出现的技术基本相同。

在语言理解、图像识别和模式检测等任务中,神经网络处理器明显优于传统的计算方法。绝大多数这样的处理器(通常是重新使用GPU)都被设计在云服务器上运行的。

Myriad 2技术可以将深度学习框架(如Caffe和TensorFlow)转化为自己的快速原型格式。这也是为什么谷歌 采用Myriad 2技术的最新AIY Vision套件,用于Raspberry Pi Zero W的原因之一。该套件的VisionBonnet pHAT板使用了与UP AI Core相同的Movidius MA2450芯片。在VisionBonnet上,处理器运行谷歌的开源TensorFlow机器智能库,用于神经网络,使视觉感知处理速度达到每秒30帧。

英特尔和谷歌并不是唯一希望将AI加速推向边缘的公司。华为在其Mate 10 Pro手机上发布了一款Kirin 970 SoC,这款手机提供了一种神经处理协处理器,高通随后推出了带有自己的神经加速器的Snapdragon 845 SoC。Snapdragon 845将很快出现在三星Galaxy S9和其他手机中,并且还将出现在一些高端嵌入式设备上。

上个月,Arm推出了两款用于移动和嵌入式协处理器的Trillium AI芯片设计。现在可用的是Arm的第二代对象检测(OD)处理器,用于优化视觉处理和人员/物体检测。今年夏天将推出机器学习(ML)处理器,它将加速AI应用,包括机器翻译和人脸识别。

欢迎关注ATYUN官方公众号

商务合作及内容投稿请联系邮箱:bd@atyun.com

热门企业

热门职位

写评论取消

回复取消