神经元比我们现在想象的更复杂!

2018年02月11日 由 nanan 发表

21546

0

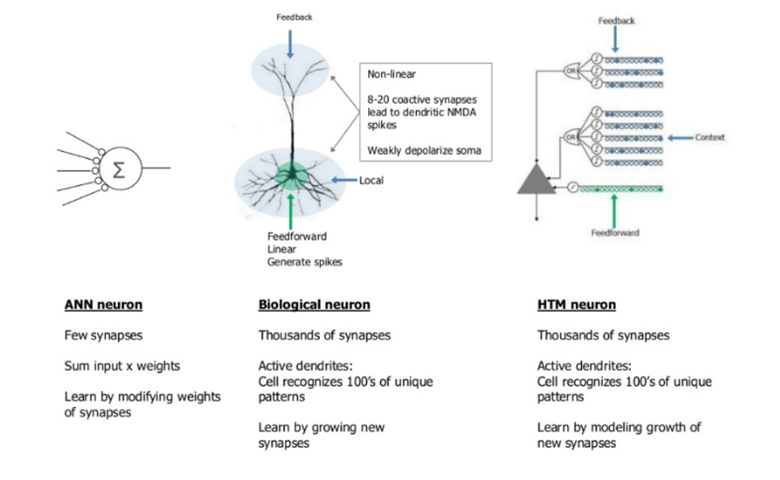

深度学习或人工神经网络(ANN)能够模拟生物神经元的观点,是个很大的误解。ANN充其量能模仿一个1957年的单个神经元模型的卡通版本。任何声称深度学习的人都是出于营销目的,或者从来没有读过生物文献。深度学习中的神经元本质上是数学函数,它对内部权重的输入执行相似函数。匹配越接近,执行动作的可能性就越大(即不向零发送信号)。这个模型也有例外,但它包含感知器、卷积网络和RNN。

Numenta公司的Jeff Hawkins一直抱怨说,需要一种更加生物化的方法。因此,他在构建认知机器的研究中,构建了一个更加贴近新皮层结构的体系。Numenta的神经元模型比神经元的深度学习模型要复杂得多,如图所示:

Numenta的团队正押注于这种方法,希望能创造出比深度学习更有能力的东西。目前还没有证据可以证明这是成功的。他们已经做了这么长时间,以至于他们中的一些人成功地减少了加班时间。相比之下,深度学习(尽管它是一个卡通神经元的模型)在执行各种令人难以置信的认知能力方面表现得出人意料的有效。深度学习正在做一些非常正确的事情,我们只是不知道那到底是什么!

不幸的是,我们不得不在所有的研究中加入新的扳手。关于神经元性质的新实验表明,生物神经元比我们想象中的更复杂:

(1)单个神经元的峰值波形通常随刺激部位的函数而变化;

(2)不同方向的细胞外刺激缺乏空间求和;

(3)结合细胞内和细胞外刺激以及非局部时间干扰(刺激的精确时间是不相关的),不能实现空间求和和相减。

简而言之,在单个神经元内发生的事情要比简单的整合和刺激的想法多得多。神经元不是纯粹的功能,而是具有我们尚未理解的行为的状态机器。

如果你认为这会给我们的理解带来麻烦,那么有一个更新的发现揭示了更大的复杂性:

- 许多由神经元释放的细胞外囊泡含有称为弧的基因,这有助于神经元彼此建立连接。被设计为缺乏Arc的小鼠具有形成长期记忆的问题,并且一些人类神经障碍与该基因相关联。

这项研究揭示了神经元之间通过发送RNA编码来相互交流的机制。这些是指令包,而不是数据包。发送代码和发送数据之间有着深刻的区别。这意味着一个神经元的行为可以改变另一个神经元的行为;不是通过观察,而是通过注入行为。

所以在现实中,即使是在我们认知的最小单位中,也有一种对话是在个体神经元之间进行的,它们改变了彼此的行为。因此,神经元不仅具有状态,而且神经元也是具有指令集和发送代码的机器。很抱歉,这只是另一个层次的复杂性。

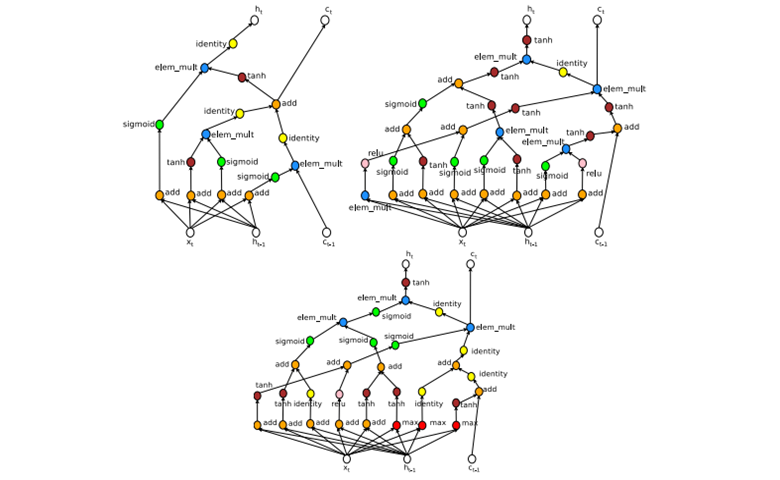

现在是时候回到绘图板,开始探索更复杂的神经元了。我们迄今为止看到的更复杂的类型是来自LSTM派生的类型。这是对LSTM-like神经元进行强力建筑搜索的结果:

现在还不清楚为什么这些更复杂的LSTM更有效。只有架构搜索算法知道,但它不能解释自己。

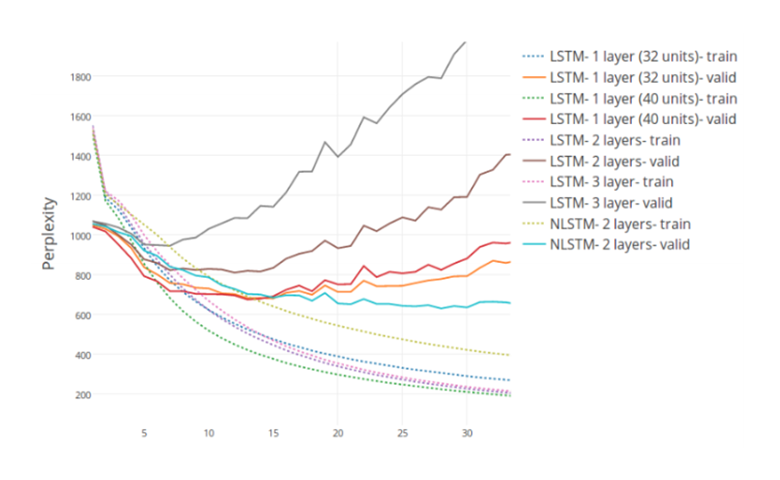

与标准的LSTM相比,它显示出可衡量的改进:

综上所述,一个探索更复杂的神经元种类的研究计划可能会带来有希望的结果。这与研究在神经网络中使用复杂值的研究没有什么不同。在这些复杂且有价值的网络中,只有在RNN网络上才会注意到性能改进。这表明,这些内部神经元的复杂性可能是超越简单感知的能力所必需的。我怀疑这些复杂性对于高级认知来说是必要的,它们似乎可以逃避当前的深度学习系统。这些包括对抗功能的强健性,学习忘记,学习什么要忽略,学习抽象和认识上下文切换。

我预计在不久的将来,我们将在这一领域看到更积极的研究。毕竟,大自然已经明确地告诉我们,神经元的个体是更复杂的,因此我们自己的神经元模型也可能需要更复杂。也许我们需要像Grassmann代数那样复杂的东西来取得进展。

欢迎关注ATYUN官方公众号

商务合作及内容投稿请联系邮箱:bd@atyun.com

热门企业

热门职位

写评论取消

回复取消